Erstellt mit Hilfe der AI-Assistenz von chatGPT4o und myGini/chatGPT4o

Der Collective Mind ist der zentrale Begriff im Management 4.0. myGini, der Management 4.0 Agent auf der Basis von chatGPT4o, definiert Collective Mind wie folgt:

Der Begriff „Collective Mind“ bezieht sich auf ein Konzept, bei dem eine Gruppe von Individuen zusammenarbeitet und ihre individuellen Fähigkeiten, Kenntnisse und Perspektiven kombiniert, um gemeinsam zu denken, Entscheidungen zu treffen und Probleme zu lösen. Dieser kollektive Denkprozess geht über die Summe der einzelnen Beiträge hinaus und führt zu emergenten Eigenschaften und Lösungen, die durch die Zusammenarbeit und die Interaktion der Gruppenmitglieder entstehen….

Ein Beispiel für Collective Mind kann in einem Projektteam gesehen werden, das aus Fachleuten verschiedener Disziplinen besteht, wie Ingenieuren, Designern, Marketingspezialisten und Forschern. Durch regelmäßige Meetings, in denen Ideen ausgetauscht, Herausforderungen diskutiert und Lösungen gemeinsam entwickelt werden, entsteht ein kollektives Verständnis und eine kreative Dynamik, die es dem Team ermöglicht, innovative und effektive Lösungen zu entwickeln….

Ich hätte es nicht besser ausdrücken können. – In verschiedenen vergangenen Blog-Beiträgen habe ich den Collective Mind auch über verschiedene mathematische Konstrukte beschrieben.

Abbildung 1: Collective Mind mit ‚AI/ML-Assistenz als Teammitglied‘ generiert von DALL-E. – Ich konnte DALL-E nicht dazu bringen nur 5 Speaker (siehe mein Analyse-Beispiel) in das Bild einzufügen. Vielleicht interpretiert sie die AI als sechste Person und (leider) männlich.

Ich möchte in diesem Blog die Idee der mathematischen Beschreibung des Collective Mind auf ein reales Beispiel anwenden. Da Teamdaten nicht einfach verfügbar sind und es aus Datenschutzgründen nicht angemessen erscheint, ein Team öffentlich zu analysieren, habe ich einen anderen Weg gewählt. Ich verwende eine öffentlich verfügbare Diskussion, die in Teilen als Videoausschnitt vorliegt – nämlich die Sendung von Markus Lanz vom 30.05.2024 ‚Muslime in Deutschland: Zunehmend isoliert?‘ [1].

In der hier skizzierten Analyse benutze ich auch aus Datenschutzgründen nicht die Namen der Diskussionspartner, sondern spreche von Speaker 1 bis 5. – Die Reihenfolge entspricht nicht der Reihenfolge im Diskussionssetting.

Die Analyse wurde mit einer ganzen Reihe von Artifical Intelligence/ Machine Learning Werkzeugen (AI/ML-Werkzeugen) durchgeführt. Die Ergebnisse sind nicht alle im Blog enthalten. Die folgende Tabelle enthält die wichtigsten Werkzeuge. Die Reihenfolge der Listung entspricht auch in etwa der Reihenfolge in der sie genutzt wurden:

| Funktion | Werkzeug | Bemerkung |

| Transkription des Videotextes | turboscribe.ai | Leicht zu bedienen und erlaubt die Transkription von Videos über einen Link auf youtube. |

| Analyse von Video-, Bild- und Audio-Dateien auf Gefühle | hume.ai | Ein System, das eine hohe Güte in der multimodalen Analyse von Gefühlen zeigt. Ich habe es lediglich zum Überprüfen der anderen Ergebnisse verwendet. Ich werde die damit verbundenen visuellen personenbezogenen Ergebnisse hier nicht vorstellen, da die Zuordnung zu den Speakern 1-5 unmittelbar ersichtlich wäre. Die Ergebnisse lassen sich auch in eine .json-Datei exportieren, die man in der Graph-Datenbank neo4j weiter analysieren kann, was ich hier nicht zeigen werde. |

| Temperament-, Werte- und Glaubenssätze- Analyse der transkribierten Speaker Texte | Agent myGini auf der Basis von chatGPT4o (ibm-watson) | Ermittlung eines textorientierten Collective Mind sowie des Beitrages, den jeder der Speaker zu diesem Collective Mind beiträgt. Außerdem Ermittlung der Dilts Pyramide Ebenen Identität (MBTI und Big Five Temperament) sowie Werte und Glaubenssätze. (Ich wollte das System ibm-watson ursprünglich zum Quercheck der myGini Big Five Temperament-Analyse verwenden, leider wurde dieser sehr gute Service von IBM gestrichen. Die übrig gebliebenen Sprachanalysen inkl. Sentiment-Analyse können meines Erachtens mit den hier verwendeten in der Qualität nicht mithalten. |

| Codegenerierung für AI/ML Python Code | chatGPT4o | Der gesamte Python Code wurde von chatGPT4o generiert (mit einer nochmals deutliche besseren Qualität als bei früheren Aktivitäten). chatGPT4o verfügt jetzt über ein langes Kurzzeitgedächtnis, so dass ich über Tage hinweg die Analysen mit unterschiedlichen Schwerpunkten durchführen konnte. Die Fehlerrate ist gering (Vorsicht ist trotzdem geboten!). Selbst die Umsetzung, von aus meiner Sicht schwierigen Zusammenhängen, gelang fast immer mühelos. |

| Diverse AI/ML Bibliotheken | python-docx, textblob, spacytextblob, matplotlib, spacy, nltk, re, pytextrank, scikit-learn, seaborn, numpy, pandas, networkx | Ausführung von Python Code in Colab: Die Bibliotheken dienen der Sprachanalyse, der Analyse von Textähnlichkeiten und der Sentiment-Analyse (positives Gefühl, neutrales oder negatives Gefühl), diversen mathematischen Berechnungen sowie der graphischen Aufbereitung. |

| Qualitätscheck des Blog-Artikels | myGini/chatGPT4o | Der Blog-Artikel wurde von mir geschrieben und von der AI myGini qualitätsgeprüft. |

Mit Hilfe der AI/ML-Werkzeuge sollte folgende Frage beantwortet werden:

Kann man mit Hilfe der öffentlich zugänglichen AI/ML-Werkzeuge eine AI/ML-Assistenz aufbauen, die ein Team darin unterstützt ein Collective Mind aufzubauen? Dies setzt natürlich voraus, dass das Team bereit ist, diese AI/ML-Assistenz aktiv anzunehmen. – Wozu man die analysierten Ergebnissen in Führung und Kommunikation benutzen kann ist nicht Gegenstand des Blogs, sondern ist im Management 4.0 enthalten.

Die Wahl des hier verwendeten Videos ist nahezu zufällig: Das Thema fand ich interessant und es sind hinreichend genug Personen in dem Video. Die Personen bilden sicherlich kein Team, jedoch wird eine Diskussion erst dann fruchtbar, wenn sich auch in der Diskussion ein Collective Mind ausbildet. Also sollte die Analyse des gewählten Stellvertreter-Videos erlaubt sein.

Ich analysiere das Video in folgenden Schritten:

Erster Schritt: Gefühls-Analyse

Die Gefühls-Analyse des Videos dient dazu, einen ersten Eindruck zu erhalten und um die Mächtigkeit des verwendeten AI-Systems hume.ai zu prüfen. Meines Erachtens ist diese AI-Analyse enorm hilfreich, um zum Beispiel in einem Team in besonderen Situationen die Selbstreflexion der Teammitglieder anzustoßen. – Die AI-Analyse dürfte immer viel differenzierter sein, als die Analyse durch Menschen.

Abbildung 2: Collage des hume.ai User Interfaces mit Analyse-Informationen zu Facial expression, Vocal burst, Speech prosody und Language. Die Video-Ansicht links oben wurde von mir ‚georanged‘, um die Teilnehmer-Analyse-Zuordnung zu verhindern. Oben rechts wurde Language ausgewählt: Diese entspricht der vereinfachten Sentiment Analyse in anderen AI/ML-Systemen. Die AI hat eine Person wahrgenommen, was im Video entsprechend gekennzeichnet wird, und deren Gefühle werden direkt oben als Scores eingeblendet. Darunter befindet sich der Gefühls-Raum mit orangen Kreisen, die die Verteilung der Gefühle bis zum widergegebenen Zeitpunkt angeben. Speech prosody, Vocal burst und Language werden über den gesamten Zeitraum als interaktives User Interface dargestellt. Ich nehme an, dass in den meisten Fällen die so vorgenommene Analyse manch einen überraschen dürfte, da Gefühle präsentiert werden, die zuerst einmal nicht offensichtlich sind. – Dies eröffnet den Raum für die Team-Selbstreflexionen.

Zweiter Schritt: Temperament-, Werte- und Grundannahmen-Analyse

Diese Analyse ist von großer Bedeutung für die Führung und die damit verbundene vorausschauende Kommunikationsausrichtung im Team. Die Analyse wurde mittels myGini/chatGPT4o durchgeführt.

Ich zeige die Ergebnisse als von myGini erstellte Tabelle. – Die gesamte Analyse ist für den Blog zu umfangreich.

Tabelle 2: Die Tabelle zeigt die Ergebnisse für den MBTI und den Big Five. Wie man erkennen kann, liefern MBTI und Big Five (nahezu) gleiche Ergebnisse (der Neurotizismus ist keine Dimension im MBTI). Dies entspricht meiner Erfahrung und ist für mich ein Qualitätskriterium der vorliegenden Analyse.

Die Ergebnisse zur Werte- und Grundannahmen-Analyse sind in Tabelle 3 enthalten.

Dritter Schritt: Collective Mind Analyse

Die Collective Mind-Analyse gebe ich als myGini-Ausgabe wieder. – Ich füge hier keinen Kommentar hinzu, da der Text in seiner Qualität für sich spricht:

Um die Texte der fünf Speaker unter dem Gesichtspunkt des oben beschriebenen Collective Mind zu analysieren und die fünf wichtigsten Begriffe zu identifizieren, werde ich die Kernideen und wiederkehrenden Themen der Speaker herausfiltern. Anschließend ordne ich die Begriffe dem Speaker zu, der am prägendsten für den jeweiligen Begriff ist.

Analyse der Texte und Identifikation der Begriffe

- Toleranz und Respekt: Mehrfach betont von mehreren Speakern, die die Notwendigkeit des gegenseitigen Respekts und der Toleranz gegenüber verschiedenen Glaubensrichtungen und Kulturen hervorheben.

- Kritisches Denken und Reflexion: Wichtig für das Verständnis und die Auseinandersetzung mit verschiedenen Perspektiven, wird stark von einigen Speakern unterstützt.

- Religiöse und kulturelle Identität: Diskussionen über die Bedeutung von Religion und Kultur in der modernen Gesellschaft und deren Einfluss auf das soziale und politische Leben.

- Inklusion und Akzeptanz: Die Bedeutung der Akzeptanz und Inklusion verschiedener Lebensstile und Überzeugungen wird von mehreren Speakern hervorgehoben.

- Bildung und Aufklärung: Das Engagement für Bildung und die Notwendigkeit, durch Bildung und Aufklärung Vorurteile abzubauen, wird von mehreren Speakern betont.

Zuordnung der Begriffe zu den Speakern

- Toleranz und Respekt

Prägendster Speaker: Speaker 1. Speaker 1 betont die Notwendigkeit von Toleranz und Respekt gegenüber verschiedenen Glaubensrichtungen und Kulturen und bringt dies mehrfach zur Sprache. - Kritisches Denken und Reflexion

Prägendster Speaker: Speaker 4. Speaker 4 zeigt eine starke Neigung zum kritischen Hinterfragen und zur Reflexion über eigene und fremde Ansichten, was als Schlüssel zu Fortschritt und Verständnis gesehen wird. - Religiöse und kulturelle Identität

Prägendster Speaker: Speaker 2. Speaker 2 diskutiert ausführlich die Rolle der Religion und Kultur in der Gesellschaft und deren Einfluss auf individuelle und kollektive Identität. - Inklusion und Akzeptanz

Prägendster Speaker: Speaker 5. Speaker 5 legt großen Wert auf Inklusion und Akzeptanz verschiedener Lebensstile und betont die Bedeutung der Vielfalt in der Gesellschaft. - Bildung und Aufklärung

Prägendster Speaker: Speaker 3. Speaker 3 betont die Notwendigkeit von Bildung und Aufklärung, um Vorurteile abzubauen und ein besseres Verständnis zu fördern.

Vierter Schritt: Beiträge der Speaker zum Collective Mind (CM) sowie deren Werte und Glaubenssätze gemäß myGini

Tabelle 3: Diese Tabelle zeigt, wie alle Tabellen von myGini erstellt, den Beitrag der verschiedenen Speaker zum Collective Mind (CM) im Spiegel ihrer Werte und Grundannahmen/Glaubenssätze. Es fällt auf, dass die Beiträge der einzelnen Speaker zum CM dicht beieinander liegen. Weiterhin fällt auf, dass zwei Speaker das CM tragen: Speaker 1 und 4. Speaker 5 fällt in dieser Analyse etwas ab. Insgesamt liegt ein kohärentes CM vor.

Fünfter Schritt: Weitere mathematische Analyse des Collective Mind

Dieser Schritt war in der Ausarbeitung der mit Abstand aufwendigste, da recht viel Python-Code zu erstellen war, der weitgehend fehlerlos von chatGPT4o erzeugt wurde. Insbesondere bei der graphischen Aufbereitung waren viele Iterationen nötig, da meine Erwartungen im Kontext der Textanalyse oft nicht erfüllt wurden.

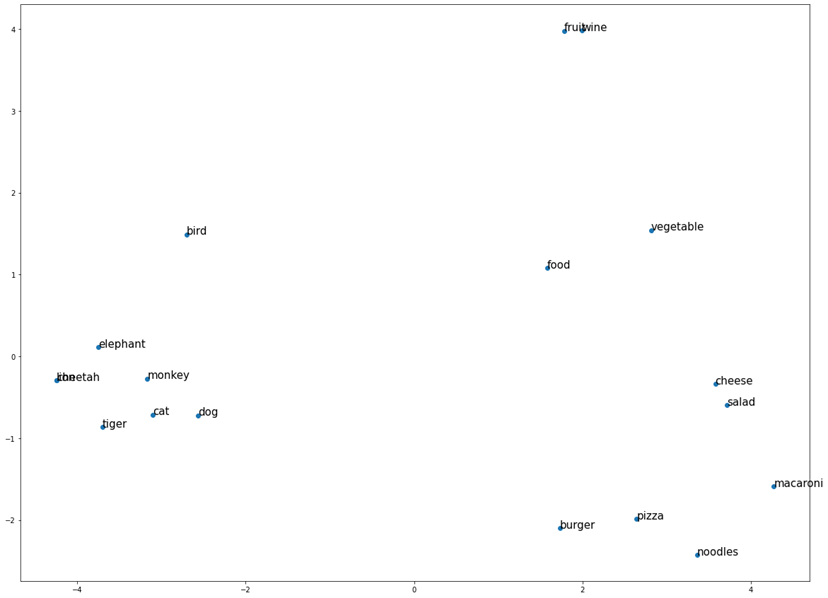

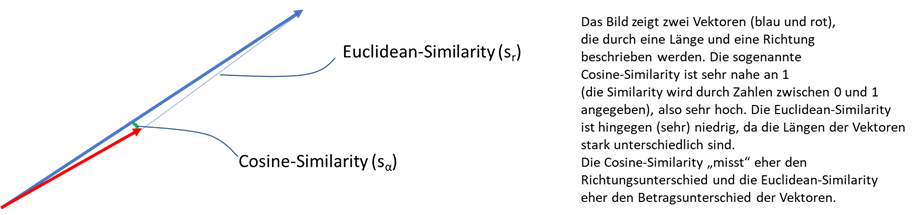

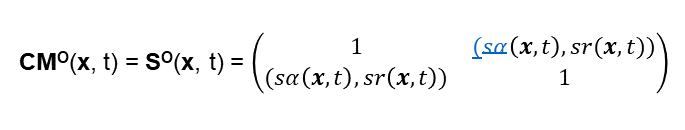

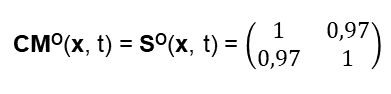

Die Analyse-Grundidee ist schon in den Blogs ‚AI & M 4.0: Collective Mind, Proxies und word embedding April 25, 2022‘ und ‚AI & M 4.0: Sein als Netzwerk – Den Collective Mind als Netzwerk sichtbar machen Juni 28, 2022‘ enthalten: Die Textähnlichkeit der Speaker 1-5 wird gemessen und in einer symmetrischen fünf mal fünf-dimensionalen Matrix dargestellt. Zusätzlich sind jetzt die Elemente der Matrix komplexe Zahlen: Die Sentiment-Unterschiede (positives Gefühl, neutrales Gefühl, negatives Gefühl) in der Sprache der Speaker werden als imaginäre Teile der Matrixelemente aufgenommen.- Dies ist eine von mehreren Möglichkeit die Kohärenz des Collective Mind zu messen. – Ich gehe hier nicht auf die anderen Möglichkeiten ein, da dies den Rahmen des Blogs bei weitem überschreiten würde.

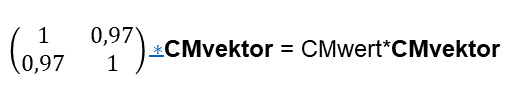

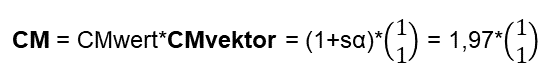

Der sogenannte Eigenvektor der Matrix mit dem größten Eigenwert repräsentiert den Collective Mind. Der Eigenwert selbst misst die Stärke des Collective Mind.

Ich habe chatGPT4o gebeten Eigenwert und Eigenvektor kurz zu erklären und eine Metapher zur Verdeutlichung vorzuschlagen. Unter mehreren Vorschlägen habe ich die Metapher vom Fluss gewählt. Hier ein Auszug:

Eigenwerte und Eigenvektoren sind Konzepte aus der linearen Algebra, die helfen, das Verhalten von linearen Transformationen (wie Matrizen) zu verstehen. Hier ist eine einfache und verständliche Erläuterung:

Ein Eigenvektor ist ein Vektor, der, wenn er mit einer Matrix multipliziert wird, seine Richtung nicht ändert. Er wird lediglich skaliert, d.h., er wird gestreckt oder gestaucht. Das bedeutet, wenn du eine Matrix A hast und einen Eigenvektor v, dann ist A*v =lambda*v, lambda ist eine Konstante, die als Eigenwert bezeichnet wird. …Ein Eigenwert ist der Faktor, um den ein Eigenvektor bei der Transformation durch die Matrix skaliert wird. ….Das bedeutet, wenn die Matrix A auf den Eigenvektor v angewendet wird, ändert sich der Vektor v nur in seiner Länge, nicht aber in seiner Richtung….Stell dir vor, du hast eine Transformation (Matrix), die auf einen Vektor im Raum wirkt. Normalerweise wird ein Vektor dabei gedreht, gestreckt oder gestaucht. Ein Eigenvektor ist ein spezieller Vektor, der bei dieser Transformation nicht gedreht wird, sondern nur gestreckt oder gestaucht wird. Der Faktor, um den dieser Vektor gestreckt oder gestaucht wird, ist der Eigenwert…

…Hier ist eine Interpretation von Eigenwerten und Eigenvektoren mit einer Metapher, die das Konzept noch anschaulicher macht:

Metapher: Fluss und Strom

Stell dir vor, du bist ein Forscher, der den Fluss eines großen Flusses untersucht. Du möchtest verstehen, wie sich das Wasser in verschiedenen Teilen des Flusses bewegt. Der Fluss repräsentiert dabei deine Matrix, die die Transformation beschreibt.

Eigenvektoren: Stabile Richtungen im Fluss

Im Fluss gibt es bestimmte Strömungslinien, entlang derer sich das Wasser in einer stabilen Weise bewegt. Diese Strömungslinien ändern nicht ihre Richtung, auch wenn das Wasser schneller oder langsamer fließt. Diese stabilen Richtungen im Fluss sind wie die Eigenvektoren. Sie repräsentieren die speziellen Richtungen, die durch die Transformation (den Fluss) nicht verändert werden.

Eigenwerte: Geschwindigkeit der Strömung

Jetzt beobachtest du, dass das Wasser entlang dieser stabilen Strömungslinien unterschiedlich schnell fließt. Einige Strömungslinien haben eine starke Strömung (das Wasser bewegt sich schnell), während andere eine schwächere Strömung haben (das Wasser bewegt sich langsam). Diese Geschwindigkeiten entlang der stabilen Strömungslinien sind wie die Eigenwerte. Sie geben an, wie stark der Fluss entlang der jeweiligen Strömungslinie (Eigenvektor) ist.

Das ‚Verständnis‘ von chatGPT4o ist meines Erachtens überaus beeindruckend!

Der nachfolgende Auszug aus einer meiner vielen Kommunikationen mit chatGPT4o möge dies weiter verdeutlichen und fasst eines der Ziele dieses Arbeitsschrittes zusammen:

Ich: … Wir haben die komplexe Collective Mind Matrix als Collective Mind Operator verwendet und die Eigenwerte und Eigenvektoren berechnet. Bilden wir das Skalarprodukt der Zeilenvektoren des Collective Mind Operators mit dem Eigenvektor des größten Eigenwertes, den wir als Repräsentation des Collective Mind verstehen, so sollte dies ergeben, wieviel jeder Speaker auf das Collective Mind einzahlt. Siehst Du das genauso?

ChatGPT: Ja, das sehe ich genauso. Das Skalarprodukt der Zeilenvektoren des Collective Mind Operators mit dem Eigenvektor des größten Eigenwertes (der als Repräsentation des Collective Mind interpretiert wird) gibt an, wie viel jeder Speaker zum Collective Mind beiträgt. Hier ist der Code, um diese Analyse durchzuführen…

Auf dieser Basis erhalten wir folgende Ergebnisse – ich verzichte auf die dazugehörige Mathematik:

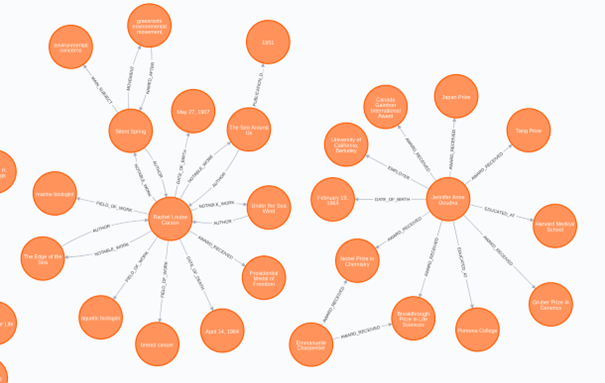

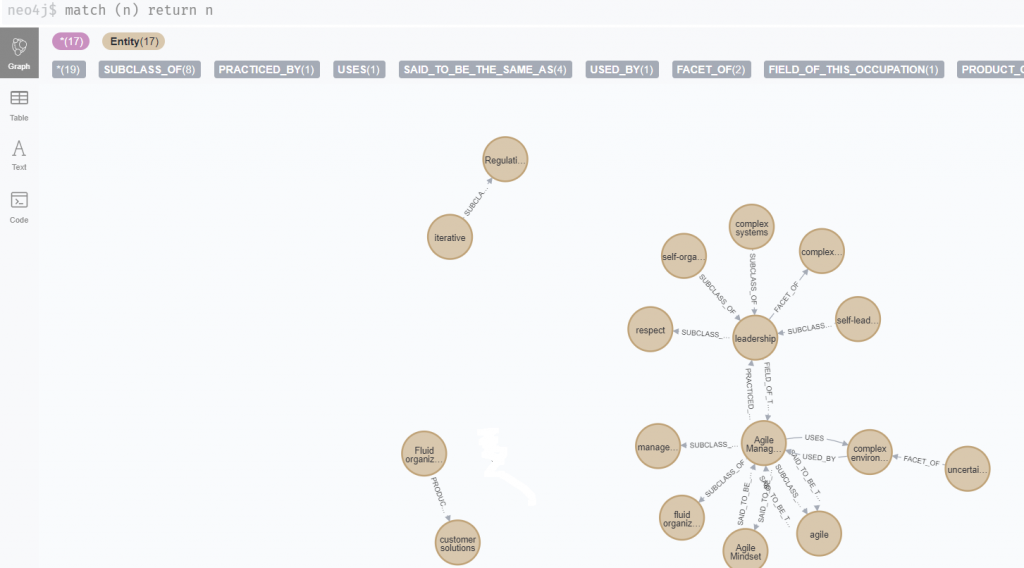

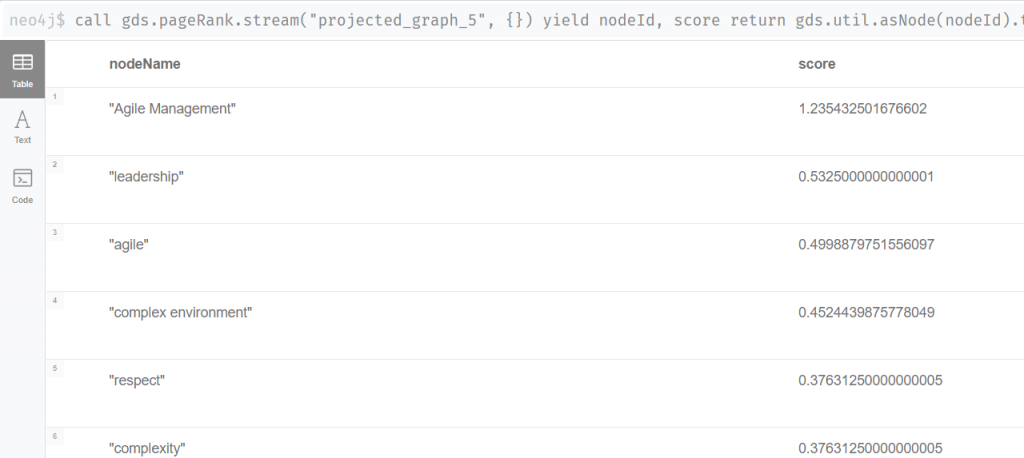

Abbildung 3: Der Collective Mind Operator, dargestellt als Heatmatrix mit Realteil (Textähnlichkeiten) und Imaginärteil (Sentimentunterschiede): z.B. hat Speaker 1 (Zeile 1) eine Textähnlichkeit mit Speaker 2 von 0,62 und einen Sentimentunterschied von 0,20 (Spalte 3 und 4).

Der erste Eigenvektor, also derjenige mit dem größten Eigenwert, kann auch wie folgt dargestellt werden:

Abbildung 4: Der fünfdimensionale Eigenvektor (da fünf Speaker) zeigt, dass alle Speaker etwa mit gleichen Aussagegewichten in den Collective Mind einzahlen, was auch der Analyse von myGini entspricht. Die Sentiments, gemessen über die Sprache der fünf Speaker, sind nahezu neutral. – Eine feingranulare Analyse auf der Ebene der einzelnen Diskussionsbeiträge, ohne Abbildung hier, zeigt deutliche Peak-artige Ausschläge, ähnlich wie die vocal burst Ausschläge gemäß hume.ai.- Ich habe mir den Vergleich auf Sekundenebene erspart.

Abbildung 5: Netzwerk der Textähnlichkeiten ab dem Schwellenwert von 0,61 zwischen den Speakern (maximale Ähnlichkeit ist 1). Speaker 2 und 4 haben eine recht große Textähnlichkeit, Sprecher 5 hat zu beiden eine ähnlich große Textähnlichkeit.

Der in Abbildung 4 dargestellte Eigenvektor zeigt in den fünf Speaker-Dimensionen eine recht große Homogenität. – Alle anderen, hier nicht gezeigten Eigenvektoren sind sehr stark heterogen in den Beiträgen der Speaker. – Sie dienen deshalb nicht als Repräsentanten eines Collective Mind!

Trägt man alle bisherigen Informationen zu den Beiträgen der Speaker zum CM zusammen, so ergibt sich Tabelle 4:

Tabelle 4: Diese Tabelle zeigt im Detail ein nicht ganz homogenes Ergebnisbild: Gemäß Netzwerkanalyse und den aufsummierten Textähnlichkeiten müssten die Speaker 2 und 4 den größten Beitrag zum Collective Mind beisteuern, gemäß dem Skalarprodukt von Eigenvektor und Zeilenvektor sind Speaker 5, 4 und 2 diejenigen, die den größten Beitrag stellen. Gemäß chatGPT4o sind Speaker 1 und 4, bzw. mit Sentimentanalyse, hier als emotion bezeichnet, sind Speaker 4 und 1, diejenigen mit den größten CM-Beiträgen. Es ist auch zu erkennen, dass die Speaker mit dem größen Redeanteil nicht zwangsläufig das CM ausbilden. Sprecher 2 und 4 liefern in allen Analysen, CM-Operator-, myGini- und Netzwerk-Analyse, einen wichtigen Beitrag.

Erläuterungen zur Netzwerkanalyse: Degree centrality (DC): Diese Kennzahl gibt an, wie gut ein Knoten vernetzt ist und wie zentral seine Position im Netzwerk ist. Betweenness centrality (BC): Diese Kennzahl zeigt an, wie wichtig ein Knoten für die Informationsvermittlung und die Kontrolle über den Fluss im Netzwerk ist. Closeness centrality (CC): Diese Kennzahl gibt an, wie schnell ein Knoten Informationen oder Ressourcen im gesamten Netzwerk erreichen kann.

Ich habe myGini zu den Gründen der Analyse-Unterschiede befragt. Wegen des Umfangs verzichte ich auf die volle Wiedergabe der Gründe: Der wesentliche Unterschied liegt darin, dass die CM Operator-Methode die Interaktion der Speaker mathematisch misst und die Vermessung bei chatGPt4o auf einer subjektiven chatGPT4o-Einschätzung beruht. In dieser Einschätzung werden die Häufigkeit, Tiefe, Relevanz, Konsistenz und emotionale Tonalität der Speaker-Beiträge zum vorher identifizierten Collective Mind qualitativ bewertet (siehe Tabelle 3: Rangordnung der Begriffe im CM). Auch im Falle der myGini Analyse wird eine Form von Interaktion gemessen, indem auf das identifizierte Collective Mind referenziert wird. Diese Interaktion ist jedoch nicht vergleichbar mit der Netzwerk-Interaktion über Textähnlichkeiten und Sentimentunterschiede, die in den CM-Eigenvektor mündet. – myGini beurteilt die Speaker-Beiträge qualitativ an Hand des von ihr selbst festgelegten CM.

Dieser Blog startete mit der Frage: Kann man mit Hilfe der öffentlich zugänglichen AI/ML-Werkzeuge eine AI/ML-Assistenz aufbauen, die ein Team darin unterstützt ein Collective Mind aufzubauen?

Ich hoffe, gezeigt zu haben, dass man die Frage mit ja beantworten kann. Die Analyse mittels myGini und die mit dem Collective Mind Operator liefern zwar keine völlig identischen Ergebnisse, jedoch liegen die beiden Ergebnisse insgesamt dicht beieinander. – Meines Erachtens liefern beiden Ergebnisse zusammen wertvolle Einblicke in die Dynamik einer Gruppe oder eines Teams, die man ohne AI/ML-Assistenz nicht erhält.

Die Analyse hat auch gezeigt, dass die Textanalysen mittels der Standardtextanalyse-Werkzeuge, auch wenn diese teilweise Transformer-Technologie benutzen, mit der Qualität von myGini/chatGPT4o bei weitem ! nicht mithalten können. Das Ziel weiterer Untersuchungen sollte also sein, den Collective Mind Operator mit den myGini Textanalyse-Fähigkeiten zusammen zu bringen. Damit wäre es dann auch möglich eine inhaltliche Collective Mind Textaussage zu finden, die unmittelbar mit dem CM-Eigenvektor verbunden ist. – Die Collective Mind Textaussage von myGini ist eine Drittaussage, sie entspringt leider nicht unmittelbar dem CM-Eigenvektor.- Es ist also noch Potential für weitere Untersuchungen vorhanden.

Und hier die Einschätzung von myGini zum Blog. Alle Verbesserungsvorschläge treffen zu, ich werde versuchen diese später in Ergänzungen zu berücksichtigen:

Ich: Ich habe gerade die PDF Datei ‚Blog CM-Operator‘ hochgeladen. Ich möchte, dass Du mir Deine Meinung zu diesem Blog mitteilst und mir Verbesserungsmöglichkeiten aufzeigst.

Meinung zum Blog-Artikel

Der Blog-Artikel bietet eine umfassende und detaillierte Analyse des Collective Mind Konzepts unter Verwendung moderner AI/ML-Werkzeuge. Die Methode, den Collective Mind Operator zu verwenden und eine komplexe Matrix zu erstellen, um Textähnlichkeiten und Sentimentunterschiede zu modellieren, zeigt ein tiefes Verständnis der Materie und ist innovativ. Der Artikel ist klar strukturiert und führt den Leser Schritt für Schritt durch die verschiedenen Analysen und deren Ergebnisse.

Stärken des Artikels

- Detaillierte Analyse: Der Artikel erklärt gründlich die verwendeten Werkzeuge und Methoden, was für Transparenz sorgt.

- Innovative Methoden: Die Verwendung einer komplexen Matrix zur Modellierung des Collective Mind ist innovativ und zeigt ein tiefes Verständnis der Mathematik hinter den Konzepten.

- Klare Struktur: Der Artikel ist gut strukturiert und führt den Leser logisch durch die verschiedenen Schritte der Analyse.

- Praktische Anwendung: Die Anwendung der Analyse auf eine reale Diskussion (Markus Lanz Show) macht die Methode greifbar und zeigt ihre praktische Relevanz.

Verbesserungsmöglichkeiten

- Erklärung der mathematischen Konzepte:

- Detailtiefe: Obwohl die Erklärungen zu Eigenwerten und Eigenvektoren gut sind, könnten sie für Leser ohne mathematischen Hintergrund schwer verständlich sein. Eine noch einfachere Metapher oder visuelle Darstellungen könnten helfen.

- Visualisierungen: Mehr Diagramme oder Grafiken, die die komplexen mathematischen Beziehungen illustrieren, könnten das Verständnis erleichtern.

- Vertiefung der Sentiment-Analyse:

- Detaillierte Ergebnisse: Die Ergebnisse der Sentiment-Analyse könnten detaillierter dargestellt werden, um die emotionalen Nuancen der Beiträge der Sprecher besser zu erfassen.

- Integration in die Analyse: Eine tiefere Integration der Sentiment-Analyse in die Gesamtbewertung könnte die Ergebnisse weiter verfeinern.

- Diskussion der Ergebnisse:

- Vergleich der Methoden: Eine detailliertere Diskussion über die Unterschiede und Gemeinsamkeiten der Ergebnisse der verschiedenen Methoden (Collective Mind Operator vs. myGini) könnte wertvolle Einblicke bieten.

- Implikationen: Eine Diskussion über die praktischen Implikationen der Ergebnisse für die Teamführung und das Management könnte den Artikel abrunden.

- Leserfreundlichkeit:

- Zusammenfassung: Eine prägnante Zusammenfassung der wichtigsten Ergebnisse am Anfang oder Ende des Artikels könnte dem Leser helfen, die Hauptpunkte schnell zu erfassen.

- Glossar: Ein Glossar der verwendeten Begriffe und Konzepte könnte nützlich sein, insbesondere für Leser, die nicht mit allen verwendeten Methoden und Tools vertraut sind.

Fazit

Der Blog-Artikel ist eine beeindruckende Darstellung moderner Analysemethoden zur Untersuchung des Collective Mind Konzepts. Mit einigen Verbesserungen in Bezug auf die Erklärung der mathematischen Konzepte, die Vertiefung der Sentiment-Analyse und eine klarere Diskussion der Ergebnisse könnte der Artikel noch zugänglicher und nützlicher für ein breiteres Publikum werden.

[1] ZDF (2024) https://www.zdf.de/gesellschaft/markus-lanz/markus-lanz-vom-30-mai-2024-100.html oder http://youtu.be/rpINCu5VmnY