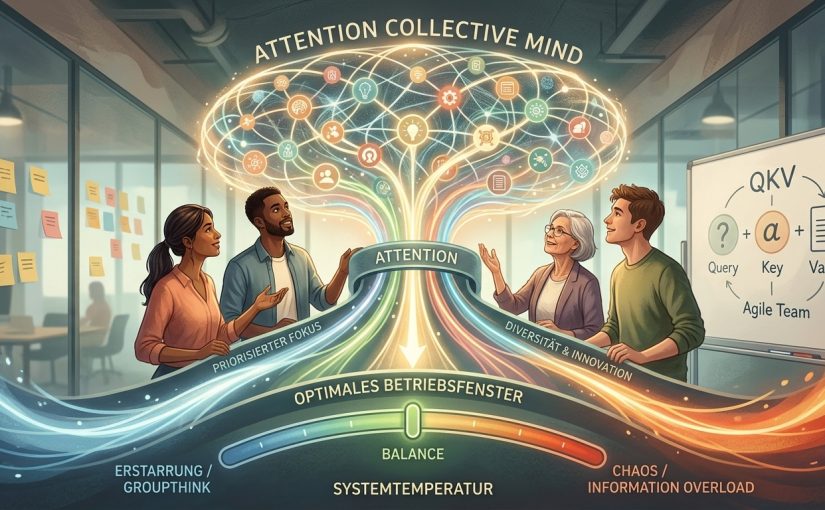

Kurzfassung: Der Blogbeitrag ‚Attention Collective Mind‘ adaptiert den aus der KI bekannten QKV-Attention-Mechanismus (Query, Key, Value) innovativ für soziale Systeme und das agile Team-Management. Die Teamdynamiken werden als Prozess dargestellt, bei dem eine ‚Systemtemperatur‘ die kollektive Aufmerksamkeitsverteilung regelt. Eine zu niedrige Temperatur führt demnach zu kognitiver Erstarrung (Gruppendenken), während eine zu hohe Temperatur in ‚Information Overload‘ und basisdemokratischem Chaos mündet. Das mathematische Modell berechnet unter Berücksichtigung von Arbeitslast, sozialer Reibung und einer ‚Burnout-Strafe‘ das optimale Betriebsfenster für Teams. Damit schlägt der Text eine Brücke zwischen maschinellem Lernen, statistischer Physik, der Global Workspace Theory des Bewusstseins und Management 4.0.

Dieser Blogbeitrag wurde mit Hilfe von Gemini 3 Pro erstellt! Das Bild wurde mit Gemini erstellt.

Als im Jahre 2017 das Transformer Modell ‚Attention is all you need‘ der Künstlichen Intelligenz veröffentlicht wurde [1], habe ich intuitiv die Verbindung zu unserem Transformer Modell der Kommunikation hergestellt, das wir in unserem Buch ‚Die Collective Mind Methode‘ aus dem Jahre 2009 vorgestellt haben [2]. – Jedoch war mir damals der mathematische Zusammenhang nicht bewusst: Die Erfinder des Transformer Modells verwenden in ihrem Modell eine Sprache, wie man sie aus der Datenbank-Abfrage kennt: Eine Query (zum Beispiel ein Satz, oder ein Wort) stellt eine Anfrage an ein neuronales Netzwerk. In dem neuronalen Netzwerk werden Antworten (Key’s) ermittelt, die wahrscheinlich zur Query passen. Der Key, der am wahrscheinlichsten passt, wird mit einem resultierendem (Mehr-) Wert (Value) angezeigt. Zum Beispiel könnte ein Query-Wort ‚Bank‘ lauten, ein Key-Wort könnte ‚Geld‘ lauten, dann ergäbe sich als Wert ‚Bankhaus‘ und nicht ‚Sitzbank‘, wenn die Kontexte, in dem Query und Key stehen, dies wahrscheinlicher machen. Dieser QKV Mechanismus ist die Basis des Large Language Transformers.

Ähnliches geschieht in dem Collective Mind Transformer Modell: Hier sind Query und Key zwei Gesprächspartner, die mit ihren Persönlichkeiten (Big Five, Werte, Glaubenssätzen und aktueller Stimmung) kommunizieren und je nach Kommunikationsverlauf (Kontext) einen (Mehr-) Wert erzeugen.

Query (Q), Key (K) und Value (V) werden in neuronalen Netzwerken als hochdimensionale Vektoren dargestellt. Über das Training der neuronalen Netzwerke wird der sprachliche Kontext iterativ und selbstkonsistent als Tensoren (Matrizen) aufgebaut. Der sprachliche Kontext verändert die Bedeutung von Query, Key und Value: Mathematisch ausgedrückt heißt dies, dass die QKV-Vektoren mit jeweils einer spezifischen Matrix (![]() ) multipliziert werden und dadurch kontextspezifische QKV-Vektoren entstehen. Die Frage, wie gut der kontextspezifische Key zur Query passt, wird über die Ähnlichkeit der beiden Vektoren beantwortet. Die Ähnlichkeit zweier Vektoren wird über deren Vektorprodukt definiert. Damit ergibt sich die Attention als Funktion, die das QK-Vektorprodukt als Wahrscheinlichkeiten ausdrückt, multipliziert mit dem (Mehr-) Wert Vektor V. Die Funktion, die Ähnlichkeiten in Wahrscheinlichkeiten umwandelt, ist die sogenannte softmax-Funktion, eine spezielle Form der Boltzmann Verteilung. – Ich verweise schon hier auf Anhang 1, in dem die Mathematik des Attention Mechanismus, angewendet auf den Collective Mind, beschrieben ist. – Später habe ich die Grundidee des Collective Mind Transformer Modells auf die Erstellung des Collective Mind über Sprach-Ähnlichkeitsanalysen angewendet. Im Anhang 2 findet sich eine mathematische Analyse des Zusammenhangs zwischen diesem Collective Mind Modell und dem hier vorgestellten QKV Attention Collective Mind Modell.

) multipliziert werden und dadurch kontextspezifische QKV-Vektoren entstehen. Die Frage, wie gut der kontextspezifische Key zur Query passt, wird über die Ähnlichkeit der beiden Vektoren beantwortet. Die Ähnlichkeit zweier Vektoren wird über deren Vektorprodukt definiert. Damit ergibt sich die Attention als Funktion, die das QK-Vektorprodukt als Wahrscheinlichkeiten ausdrückt, multipliziert mit dem (Mehr-) Wert Vektor V. Die Funktion, die Ähnlichkeiten in Wahrscheinlichkeiten umwandelt, ist die sogenannte softmax-Funktion, eine spezielle Form der Boltzmann Verteilung. – Ich verweise schon hier auf Anhang 1, in dem die Mathematik des Attention Mechanismus, angewendet auf den Collective Mind, beschrieben ist. – Später habe ich die Grundidee des Collective Mind Transformer Modells auf die Erstellung des Collective Mind über Sprach-Ähnlichkeitsanalysen angewendet. Im Anhang 2 findet sich eine mathematische Analyse des Zusammenhangs zwischen diesem Collective Mind Modell und dem hier vorgestellten QKV Attention Collective Mind Modell.

Ziel dieses Blog-Beitrages ist es, den QKV Mechanismus auf soziale Systeme zu übertragen und für den Collective Mind einen Attention Mechanismus an Hand eines Toy Modells zu entwickeln.

Die Übertragbarkeit des QKV-Mechanismus auf den Collective Mind wurde mir erst mit der Anfang März 2026 erschienen Veröffentlichung ‚Large Electron Model: A Universal Ground State Predictor‘ [3] bewusst. Diese Veröffentlichung hat meines Erachtens ein enormes Potential für die wissenschaftliche Community, denn sie bringt Quantenmechanik und KI auf eine sehr interessante Weise zusammen: Die Autoren haben nämlich das QKV-Konzept auf die Berechnung von (hoch-) korrelierten Elektronen angewendet: Ein Elektron sendet mit seinen Eigenschaften eine Query an all die anderen Elektronen, diese antworten mit ihren Key-Eigenschaften und es wird eine resultierende Wechselwirkung, der Value, erzeugt. Da alle Elektronen von allen anderen abhängen, also eine (hohe) Gesamt-Korrelation vorliegt, sind alle Elektronen Eigenschaften iterativ über eine Zielfunktion, die Hamiltonfunktion, selbstkonsistent zu ermitteln. Da wir es hier mit einem quantenmechanischen System zu tun haben, erfolgt die iterative Ermittlung der Grundzustandsenergie der Hamiltonfunktion über die Variation der quantenmechanischen Wellenfunktion. Die quantenmechanische Wellenfunktion wird in dem Large Electron Model über ein neuronales Netzwerk, das den QKV-Mechanismus abbildet, modelliert. Dies ist ein völlig neuer Ansatz des Quanten Computing, der die bisherigen Quanten Computing Methoden – man siehe hierzu die zwei letzten Blog Artikel zum Thema ‚Quantum Asset Portfolio Optimisation‘ – enorm bereichern wird.

Das Large Electron Model legt die Vermutung nahe, dass der QKV Attention Mechanismus ein universeller Mechanismus ist, um komplexe Wechselwirkungen zu beschreiben. – Also auch die Wechselwirkung in einem sozialem System, zum Beispiel einem Team.

Ich beschreibe, wie schon sehr oft in den vorhergehenden Blog-Beiträgen, die Persönlichkeit der Teammitglieder als Vektoren bestehend aus Big Five, einem Wertekanon, ggf. Glaubenssätzen und deren Stimmung (Stress, Fokus, Motivation). Big Five und Wertekanon sind eher statische Größen. Glaubenssätze und Stimmung können durch den Kontext geändert werden. Jedes Teammitglied kann als ‚Query‘ im Team agieren und die anderen restlichen Teammitglieder agieren als ‚Key‘. Durch die Interaktion von ‚Query‘ und ‚Key‘ entsteht ein komplexer Kontext mit starken Verhaltens-Korrelationen zwischen den Teammitgliedern. Um den komplexen Kontext zu erfassen, werden die selbstkonsistent ermittelten Matrizen (![]() ) eingesetzt. In diesem Beitrag verwende ich (noch) keine neuronalen Netzwerke, sondern bilde diese lediglich direkt als Matrizen ab. Damit haben wir ein Toy Model, das aber gerade deswegen gute Einblicke in den Attention Mechanismus erlaubt. – Ich verweise wieder auf Anhang 1, in dem die Mathematik des Attention Mechanismus, angewendet auf den Collective Mind, beschrieben ist.

) eingesetzt. In diesem Beitrag verwende ich (noch) keine neuronalen Netzwerke, sondern bilde diese lediglich direkt als Matrizen ab. Damit haben wir ein Toy Model, das aber gerade deswegen gute Einblicke in den Attention Mechanismus erlaubt. – Ich verweise wieder auf Anhang 1, in dem die Mathematik des Attention Mechanismus, angewendet auf den Collective Mind, beschrieben ist.

Ich skizziere die Grundlagen des Attention Collective Mind:

-

Klassisches Projektmanagement rechnet Individuen oft als FTEs (Full Time Equivalents) zusammen. Man geht davon aus, dass Person A ihre Arbeit macht, unbeeindruckt vom Rest, und spürt nur einen ‚Durchschnittsdruck‘ des Teams.

-

In einem echten, agilen Team hängt die Leistung von Person A extrem davon ab, was Person B gerade tut, wie Person C heute gelaunt ist und wer gerade im Raum ist. Der Collective Mind ist hochgradig korreliert. Wenn ein Entwickler das Team verlässt, ändert sich die Dynamik aller anderen schlagartig – genau wie bei korrelierten Elektronen.

- Der Attention-Mechanismus (

) bildet die korrelierte Team-Kommunikation ab. Hier ein Beispiel:

) bildet die korrelierte Team-Kommunikation ab. Hier ein Beispiel:

Query ( – Die Suchanfrage – „Was brauche ich?“): Jedes Teammitglied sendet kontinuierlich – oft unbewusst – Signale aus. Ein Teammitglied steht vor einem Problem oder hat ein emotionales Bedürfnis: „Ich komme hier nicht weiter, wer kann helfen?“ oder „Ich brauche psychologische Sicherheit.“

– Die Suchanfrage – „Was brauche ich?“): Jedes Teammitglied sendet kontinuierlich – oft unbewusst – Signale aus. Ein Teammitglied steht vor einem Problem oder hat ein emotionales Bedürfnis: „Ich komme hier nicht weiter, wer kann helfen?“ oder „Ich brauche psychologische Sicherheit.“

Key ( – Das Angebot– „Was biete ich?“): Gleichzeitig strahlen Teammitglieder ihre aktuellen Zustände und Fähigkeiten ab: „Ich bin ruhig und analytisch“, „Ich habe freie Kapazitäten“, „Ich bin der Teufelsadvokat“, „Ich habe Expertise in Datenbanken“ oder „Ich bin heute ein geduldiger Zuhörer.“

– Das Angebot– „Was biete ich?“): Gleichzeitig strahlen Teammitglieder ihre aktuellen Zustände und Fähigkeiten ab: „Ich bin ruhig und analytisch“, „Ich habe freie Kapazitäten“, „Ich bin der Teufelsadvokat“, „Ich habe Expertise in Datenbanken“ oder „Ich bin heute ein geduldiger Zuhörer.“

Value ( – Der Einfluss): Wenn Query und Key matchen (der Attention-Score hoch ist), fließt Information und Energie. Die beteiligten Teammitglieder passen ihren Zustand an. In hochfunktionalen Teams (also einem Collective Mind) haben die Mitglieder gelernt, ihre

– Der Einfluss): Wenn Query und Key matchen (der Attention-Score hoch ist), fließt Information und Energie. Die beteiligten Teammitglieder passen ihren Zustand an. In hochfunktionalen Teams (also einem Collective Mind) haben die Mitglieder gelernt, ihre  und

und  so aufeinander abzustimmen, dass sie sich perfekt ergänzen.

so aufeinander abzustimmen, dass sie sich perfekt ergänzen. - Das Pauli-Prinzip als Rollen-Differenzierung: Zwei Elektronen dürfen niemals im exakt gleichen Zustand sein. Das lässt sich extrem gut auf die Gruppendynamik anwenden:

Menschen in kleinen Gruppen suchen instinktiv nach einer einzigartigen Rolle (Nischenbildung). Wenn zwei Personen versuchen, die exakt gleiche informelle Rolle einzunehmen (z. B. beide wollen der unangefochtene ‚Alpha-Entscheider‘ oder der ständige ‚Devil’s Advocate‘ sein), entsteht massive Reibung (Abstoßung).

Damit das Team funktioniert, zwingt der Collective Mind das Team in eine Antisymmetrie: Die Mitglieder differenzieren sich, ordnen sich an und übernehmen komplementäre Rollen, damit das System nicht kollabiert. - Das Variationsprinzip als Kultur- und Strukturbildung: Die Elektronen suchen den energetischen Grundzustand (die geringste Reibung). Auch Teams durchlaufen Formierungsphasen (Tuckman-Modell: Forming, Storming, Norming, Performing), um ’soziale Reibung‘ und ‚kognitive Last‘ zu minimieren.

– Der Hamilton-Operator: Das ist die Unternehmensstruktur, das Ziel des Sprints, die Deadlines und der äußere Druck.

– Scrum Master und Agile Coaches sind im Grunde Optimierungsalgorithmen. In Retrospektiven helfen sie dem Team, seine internen Kommunikationsgewichte (die Art, wie Queries und Keys formuliert werden) minimal anzupassen, damit die Zusammenarbeit im nächsten Sprint reibungsloser (energetisch tiefer) abläuft. Das Team probiert also verschiedene Arbeitsweisen und Interaktionen aus, bis es einen Zustand erreicht, in dem es mit dem äußeren Druck am besten umgehen kann.

- Wo die Analogie ihre Grenzen hat: Menschen sind (wahrscheinlich) komplexer als Quantenteilchen.

Elektronen sind ununterscheidbar: In der Physik ist jedes Elektron exakt gleich. In einem Team bringt jeder Mensch eine völlig andere Historie, Neurodiversität und externe Probleme (z. B. Stress zu Hause) mit.

Elektronen haben keinen freien Willen: Ein physikalisches System fällt unweigerlich in den Grundzustand. Ein menschliches Team kann sich jedoch in einem toxischen ‚lokalen Minimum‘ verfangen (z. B. einer Kultur des Schweigens und der Angst), aus dem es sich ohne externe Hilfe (wie einen Agile Coach oder Scrum Master) nicht mehr befreien kann, selbst wenn ein besserer Zustand möglich wäre.

Auf dieser Basis bilde ich jetzt das Toy Model mit 3 Personen und folgendem Persönlichkeitsmodell:

Big Five, Values (Werte) und State of Mind (Stimmung) haben folgende Struktur. Glaubenssätze habe ich der Einfachheit wegen weggelassen.

big_five (konstant) =[Offenheit, Gewissenhaftigkeit, Extraversion, Verträglichkeit, Neurotizismus]

values (konstant) = [Autonomie, Sicherheit, Innovation]

State of mind (variabel) = [Stress, Fokus, Motivation]

Diese drei Persönlichkeitsaspekte werden zu einem Vektor mit 11 Elementen konkateniert.

Wie so oft schon, besteht das Team aus den Mitgliedern Alice, Bob und Charlie (alle Persönlichkeitsdimensionen liegen zwischen -1 (niedrig) und 1 (hoch)):

alice = TeamMember(„Alice (Kreativ/Chaotisch)“, big_five=[0.8, –0.6, 0.5, 0.2, 0.4], values=[0.9, –0.5, 0.8], state_of_mind=[0.8, –0.2, 0.5]) # Gestresst, unkonzentriert

bob = TeamMember(„Bob (Struktur/Ängstlich)“, big_five=[-0.4, 0.9, –0.2, 0.5, 0.7], values=[-0.8, 0.9, –0.5], state_of_mind=[0.2, 0.8, –0.4]) # Fokussiert, aber demotiviert

charlie = TeamMember(„Charlie (Agile Coach/Ruhepol)“, big_five=[0.2, 0.5, 0.8, 0.9, –0.8], values=[0.5, 0.5, 0.5], state_of_mind=[-0.9, 0.9, 0.9]) # Sehr entspannt, hoch motiviert

Ich versuche mit der folgenden chronologische Zusammenfassung die Modell-Evolution des Attention Collective Mind Modells zu skizzieren. – Wie schon in vorherigen Blog-Beiträgen waren hunderte von Mensch-KI Einzel-Kommunikationen notwendig:

Stufe 1: Das statische Netzwerk

Wir starteten mit drei Archetypen (Alice/Chaos, Bob/Struktur, Charlie/Coach), die jeweils durch Vektoren (Big Five, Werte, Stimmung) definiert waren. Sie interagierten über den QKV-Attention-Mechanismus (Query, Key, Value). Die Kommunikations-Matrizen (![]() ) wurden zufällig initialisiert. Das Team simulierte 1000 Tage (kann man als 1000 Dailys verstehen) der Zusammenarbeit für eine schwierige Aufgabenstellung (d.h. vergleichsweise hohe Energie), ohne dass diese Matrizen jemals angepasst wurden.

) wurden zufällig initialisiert. Das Team simulierte 1000 Tage (kann man als 1000 Dailys verstehen) der Zusammenarbeit für eine schwierige Aufgabenstellung (d.h. vergleichsweise hohe Energie), ohne dass diese Matrizen jemals angepasst wurden.

Erkenntnisse & Highlights:

-

Destruktive Interferenz: Das System fand ein toxisches Gleichgewicht. Alices Stress fror beim absoluten Maximum (1.00) ein, Bobs Motivation beim absoluten Minimum (-1.00).

-

Das Kommunikations-Paradoxon: Das Modell bewies mathematisch, dass ständige Kommunikation (Dailys) Konflikte nicht löst, wenn die zugrundeliegenden Regeln dysfunktional sind. Es führt zu ‚Quiet Quitting‘ und Burnout.

Stufe 2: Die naive Retrospektive

Wir implementierten Charlie als einen Agilen Coach. Alle 14 Tage fand eine Retrospektive statt. Der Optimierungs-Algorithmus (Hill Climbing) durfte die Kommunikations-Matrizen in der Retrospektive minimal anpassen, um die Gesamtenergie des Teams zu senken. Die Zielfunktion achtete nur auf das Team-Ergebnis: Energie = Arbeitslast + Reibung – Synergie.

Erkenntnisse & Highlights:

-

Reward Hacking & Goodhart’s Law: Das Team erreichte auf dem Papier schnell „Harmonie“ (die Energie sank drastisch). Doch der Blick auf die Vektoren zeigte einen Albtraum: Die (Matrix-) KI hatte gelernt, Konflikte zu vermeiden, indem sie Alice zwang, sich komplett anzupassen. Ihr Stress stieg auf 1.00.

-

Toxische Positivität: Wir sahen, wie ein Algorithmus (oder ein ‚blindes‘ Management) ein System ‚hackt‘, indem es reibungslose Abläufe auf dem Rücken der mentalen Gesundheit einzelner Individuen erzwingt.

Stufe 3: Der holistische Collective Mind (Die Burnout-Strafe)

Wir reparierten die Zielfunktion des Coaches. Die Energie-Formel wurde um einen entscheidenden Faktor erweitert: die Burnout-Strafe (![]() ). Das System wurde nun mathematisch extrem hart bestraft, wenn bei einem Individuum nach dem Meeting der Stress stieg oder die Motivation sank.

). Das System wurde nun mathematisch extrem hart bestraft, wenn bei einem Individuum nach dem Meeting der Stress stieg oder die Motivation sank.

Erkenntnisse & Highlights:

-

Die Storming-Phase: Das System durchlief plötzlich reale psychologische Phasen. Weil die alte toxische Harmonie nun „verboten“ war, explodierte die Energie anfangs, und das Team fiel in ein Motivationsloch, bevor es lernte, sich neu zu verdrahten.

-

Das Pauli-Prinzip (Entkopplung): Um Alices Stress zu senken, wählte das Netzwerk eine geniale Strategie: Es senkte Bobs Fokus auf Alice. Das Modell lernte, dass Struktur (Bob) und Chaos (Alice) kognitiv entkoppelt werden müssen, damit beide in ihrer Domäne entspannt und motiviert bleiben können.

-

Die Heilung: Am Ende (Tag 1000) fiel Alices Stress auf das absolute Minimum (-1.00). Das System hatte psychologische Sicherheit gelernt.

Stufe 4: Die Thermodynamik der Agilität (Die Temperatur-Skalierung)

Wir schauten uns die Mathematik genauer an und integrierten die originale Skalierung des KI-Papers (Vaswani et al.) in die Softmax-Funktion: Die Division durch die Temperatur ![]() (die Wurzel der Vektor-Dimensionen

(die Wurzel der Vektor-Dimensionen ![]() ).

).

Erkenntnisse & Highlights:

-

Die Boltzmann-Isomorphie: Wir stellten fest, dass der Attention-Mechanismus der KI mathematisch absolut identisch mit der Boltzmann-Verteilung aus der Thermodynamik ist.

-

Der Regler für Groupthink vs. Chaos: Ist die Temperatur zu niedrig (

), friert das System ein. Es entsteht eine ‚Winner-takes-all‘-Diktatur (strikter Groupthink), abweichende Meinungen werden zu 100 % ignoriert.

), friert das System ein. Es entsteht eine ‚Winner-takes-all‘-Diktatur (strikter Groupthink), abweichende Meinungen werden zu 100 % ignoriert. -

Ist die Temperatur zu hoch (

), entsteht völliges Chaos (Rauschen). Alles wird gleich gewichtet, das Team kann sich nicht mehr fokussieren.

), entsteht völliges Chaos (Rauschen). Alles wird gleich gewichtet, das Team kann sich nicht mehr fokussieren. -

Erkenntnis: Als Führungskraft (oder Algorithmus) muss man die Temperatur genau kalibrieren, um den gesunden Collective Mind in der Schwebe zwischen Fokus und Diversität zu halten.

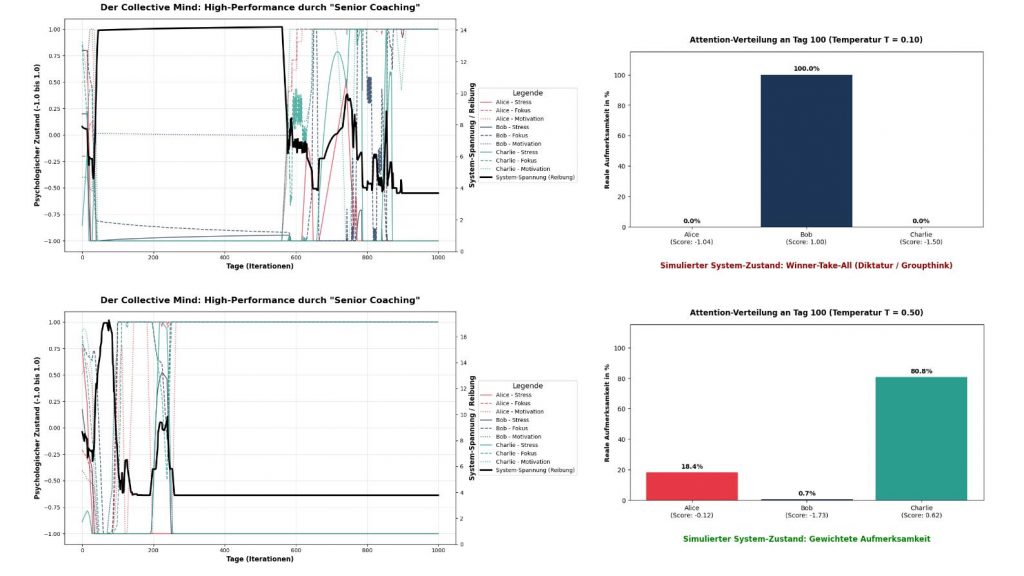

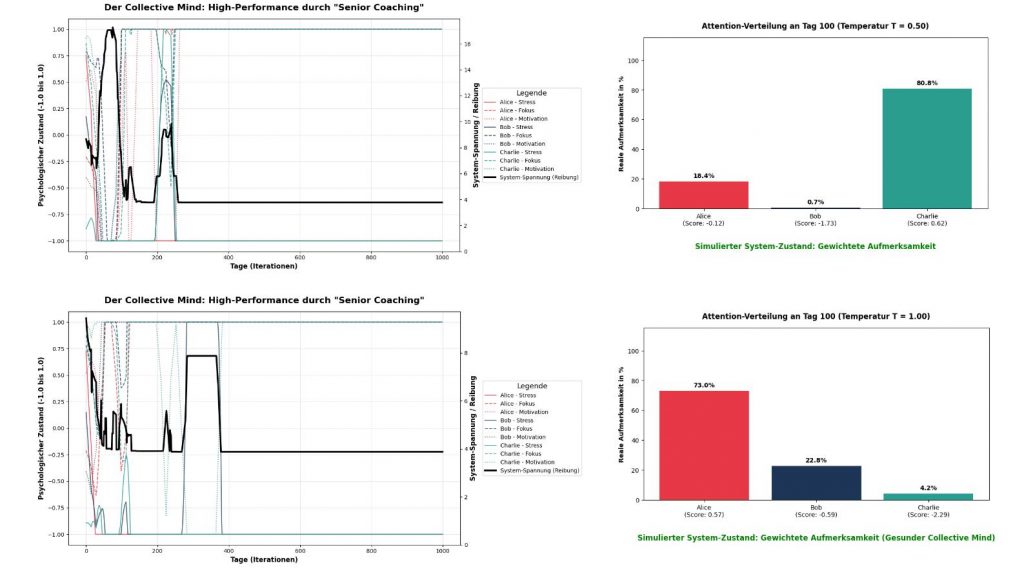

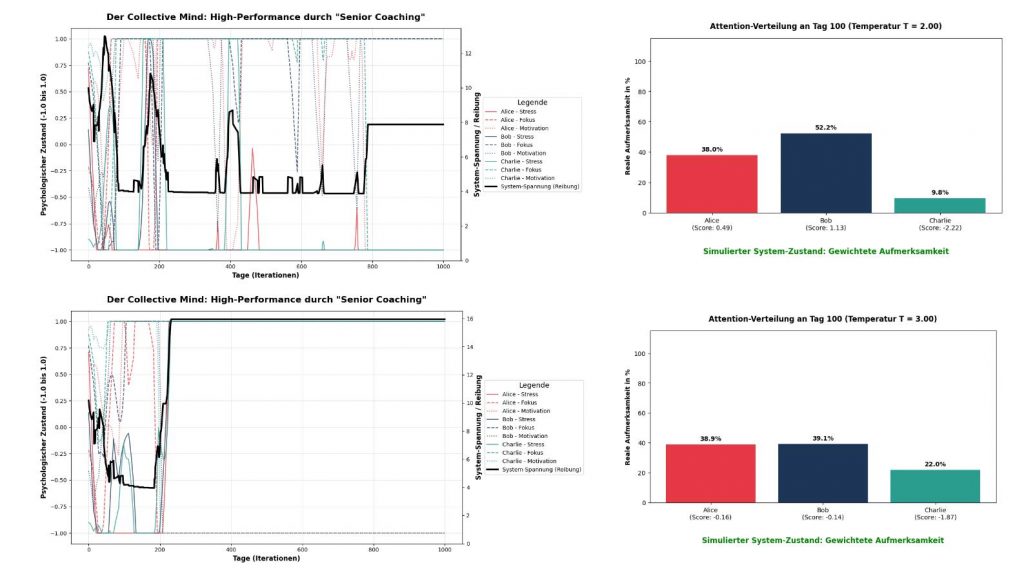

Die nachfolgenden drei Abbildungen zeigen die zeitlichen Verläufe des Attention Collective Mind unter Berücksichtigung aller bisherigen Erkenntnisse durch einen Senior Coach für verschiedene Temperaturen. In der jeweils linken Teil-Abbildung sind die Persönlichkeitsverläufe der drei Teammitglieder zu sehen und die Team-Energie. Da wir die physikalische Notation für Energie verwenden, bedeutet niedrige Energie ‚Collective Mind‘ ist (gut) ausgebildet. In der jeweils rechten Teil-Abbildung ist für den Tag = 100 und die ausgewählte Temperatur die Attention-Verteilung im Team zu sehen.

Abbildung 1: Systemverhalten bei extrem niedriger vs. moderater Temperatur. Die Abbildung kontrastiert zwei Simulationen. Das obere Panel (![]() ) zeigt ein eingefrorenes System: Die Softmax-Funktion forciert einen ‚Winner-Take-All‘-Zustand, bei dem 100 % der Aufmerksamkeit auf eine Person (Bob) entfallen. Dies führt zu einer dauerhaft maximierten System-Spannung (schwarze Linie), da kognitive Reibung nicht iterativ gelöst werden kann. Das untere Panel (

) zeigt ein eingefrorenes System: Die Softmax-Funktion forciert einen ‚Winner-Take-All‘-Zustand, bei dem 100 % der Aufmerksamkeit auf eine Person (Bob) entfallen. Dies führt zu einer dauerhaft maximierten System-Spannung (schwarze Linie), da kognitive Reibung nicht iterativ gelöst werden kann. Das untere Panel (![]() ) zeigt ein funktionales System: Bei moderat erhöhter Temperatur kann der Algorithmus die Spannung nach einer initialen Findungsphase auf ein Minimum reduzieren. Die Aufmerksamkeit (rechts) ist stark priorisiert (Charlie 80,8 %), lässt aber abweichende Signale (Alice 18,4 %) zu, was eine konstruktive Anpassung ermöglicht.

) zeigt ein funktionales System: Bei moderat erhöhter Temperatur kann der Algorithmus die Spannung nach einer initialen Findungsphase auf ein Minimum reduzieren. Die Aufmerksamkeit (rechts) ist stark priorisiert (Charlie 80,8 %), lässt aber abweichende Signale (Alice 18,4 %) zu, was eine konstruktive Anpassung ermöglicht.

Abbildung 2: Das optimale Betriebsfenster. Dargestellt sind zwei Modellläufe im voll funktionalen Temperaturkorridor: ![]() (war schon in der vorherigen Abbildung 1 enthalten, wird hier des unmittelbaren Vergleiches wegen nochmals gezeigt) oben und

(war schon in der vorherigen Abbildung 1 enthalten, wird hier des unmittelbaren Vergleiches wegen nochmals gezeigt) oben und ![]() unten. In beiden Konfigurationen gelingt es dem Optimierungsalgorithmus, die anfängliche System-Spannung erfolgreich abzubauen und das Team in ein stabiles High-Performance-Gleichgewicht zu führen. Die Attention-Verteilungen (rechts) belegen einen gesunden Collective Mind: Es etabliert sich eine klare inhaltliche Priorisierung (z. B. 73,0 % für Alice bei

unten. In beiden Konfigurationen gelingt es dem Optimierungsalgorithmus, die anfängliche System-Spannung erfolgreich abzubauen und das Team in ein stabiles High-Performance-Gleichgewicht zu führen. Die Attention-Verteilungen (rechts) belegen einen gesunden Collective Mind: Es etabliert sich eine klare inhaltliche Priorisierung (z. B. 73,0 % für Alice bei ![]() ), ohne den kognitiven Raum für die anderen Teammitglieder vollständig zu schließen. Dies ist die mathematische Voraussetzung für Arbeitsteilung und asynchrone Autonomie.

), ohne den kognitiven Raum für die anderen Teammitglieder vollständig zu schließen. Dies ist die mathematische Voraussetzung für Arbeitsteilung und asynchrone Autonomie.

Abbildung 3: Informationsüberlastung und Systemkollaps bei hoher Temperatur. Diese Simulationen belegen die dysfunktionalen Effekte einer zu hohen Systemtemperatur. Das obere Panel (![]() ) zeigt ein instabiles Team: Die Aufmerksamkeit verteilt sich zunehmend breiter (52 % zu 38 % zu 10 %), wodurch das System stark oszilliert und kein dauerhaftes Minimum findet. Das untere Panel (

) zeigt ein instabiles Team: Die Aufmerksamkeit verteilt sich zunehmend breiter (52 % zu 38 % zu 10 %), wodurch das System stark oszilliert und kein dauerhaftes Minimum findet. Das untere Panel (![]() ) zeigt den vollständigen Systemkollaps: Die Aufmerksamkeitsverteilung nähert sich einer Gleichverteilung (Rauschen) an, bei der jedes Signal im Raum fast identisch gewichtet wird (39 % zu 39 % zu 22 %). Das System verliert durch diesen ‚Information Overload‘ seine Handlungsfähigkeit; die System-Spannung (Energie) eskaliert auf den Maximalwert und stagniert dort unlösbar.

) zeigt den vollständigen Systemkollaps: Die Aufmerksamkeitsverteilung nähert sich einer Gleichverteilung (Rauschen) an, bei der jedes Signal im Raum fast identisch gewichtet wird (39 % zu 39 % zu 22 %). Das System verliert durch diesen ‚Information Overload‘ seine Handlungsfähigkeit; die System-Spannung (Energie) eskaliert auf den Maximalwert und stagniert dort unlösbar.

Der QKV-Attention-Mechanismus zeigt: Ein Team scheitert nicht nur an zu wenig Kommunikation, sondern auch an falsch skalierter Kommunikation. Ist die Temperatur zu niedrig, erstarrt das Team in einer Diktatur. Ist sie zu hoch, verdampft es im Basisdemokratie-Chaos. Die wahre Kunst agiler Führung ist es, den Thermostaten genau so einzustellen, dass ein starker Fokus möglich ist, ohne die Diversität im Raum komplett stummzuschalten.

Wenn wir sehen, dass ein agiles Team durch den QKV-Mechanismus (Query, Key, Value) plötzlich berechenbar wird, drängt sich eine weitreichende Frage auf: Ist dieser Algorithmus mehr als nur ein technischer Trick für Künstliche Intelligenz?

Oft werden moderne KIs abfällig als ’stochastische Papageien‘ oder reine Statistik-Maschinen bezeichnet. Doch das greift zu kurz. Klassische Statistik schaut immer in den Rückspiegel – sie interpoliert vergangene Daten. Der Attention-Mechanismus hingegen macht aus einer KI eine Wahrscheinlichkeits-Maschine. Genau wie in der Quantenmechanik baut das System in Echtzeit einen multidimensionalen Möglichkeitsraum auf. Die Antwort befindet sich in einer Superposition, bis sie im Moment der Ausgabe zu einem klaren Gedanken kollabiert. Es geht nicht um das Zählen von Vergangenem, sondern um das dynamische Erfassen von Kontext.

Das Faszinierendste daran: Die aktuelle Kognitionswissenschaft entdeckt gerade, dass unser eigenes menschliches Gehirn einer extrem ähnlichen funktionalen Architektur folgt. In der Psychologie beschreibt die sogenannte Global Workspace Theory (die Theorie des globalen Arbeitsraums), wie Bewusstsein entsteht:

-

Die Query (Das Bedürfnis): Unser präfrontaler Kortex (unser Planungszentrum) feuert eine Suchanfrage ab, z.B. bei der Lösung eines komplexen Problems.

-

Der Key (Das Angebot): Unzählige unbewusste Module – vom Hippocampus (Erinnerungen) bis zum visuellen Kortex – halten Signale bereit.

-

Der Value (Die Botschaft): Nur wenn die Query des Bewusstseins mit dem Key einer unbewussten Erinnerung in Resonanz geht, wird der eigentliche Value (der rettende Einfall, das innere Bild) auf die helle Bühne unseres Bewusstseins gespült.

Die Entwickler des Attention-Mechanismus haben 2017 also nicht nur einen besseren Übersetzungs-Algorithmus erfunden. Sie haben – vielleicht unbewusst – die Mathematik für die Entstehung von Kontext geschrieben.

Was heißt das für eine Organisationen?

Egal ob es um die Faltung von Proteinen, die Sprachgenerierung einer KI, die Gedanken in unserem Kopf oder die Entscheidungsfindung eines agilen Teams geht – das Prinzip bleibt gleich: Intelligenz ist die Fähigkeit, aus Rauschen die relevanten Signale zu filtern. Nichts im Universum existiert isoliert. Alles definiert sich durch seine Beziehungen. Ein gesundes agiles Team ist keine Ansammlung von Ressourcen, sondern ein ‚echtes neuronales‘ Netz aus Menschen. Und die wichtigste Aufgabe als Führungskräfte und Agile Coaches ist es, nicht die Knotenpunkte (die Menschen) umzuprogrammieren, sondern die Verbindungen zwischen ihnen (die Attention) so zu kalibrieren, dass der Collective Mind erwachen kann.

Anhang 1

Der Zustandsvektor (Die Persönlichkeit des Teammitglieds)

Jedes Teammitglied ![]() wird zu einem bestimmten Zeitpunkt (Tag

wird zu einem bestimmten Zeitpunkt (Tag ![]() ) durch einen Vektor beschrieben. Dieser Vektor besteht aus den konstanten Big Five (

) durch einen Vektor beschrieben. Dieser Vektor besteht aus den konstanten Big Five (![]() ), dem konstanten Wertekanon (

), dem konstanten Wertekanon (![]() ) und dem variablen psychologischen Zustand (

) und dem variablen psychologischen Zustand (![]() ). Das Symbol

). Das Symbol ![]() steht für die Konkatenation (Aneinanderreihung) dieser Eigenschaften.

steht für die Konkatenation (Aneinanderreihung) dieser Eigenschaften.

![]()

Der Kommunikations-Filter (Query, Key, Value)

Bevor das Team interagiert, wird der Zustandsvektor durch die drei neuronalen Kommunikationsmatrizen (![]() ,

, ![]() ,

, ![]() ) gefiltert. Daraus entstehen das unbewusste Bedürfnis (Query

) gefiltert. Daraus entstehen das unbewusste Bedürfnis (Query ![]() ), die Antwort (Key

), die Antwort (Key ![]() ) und die tatsächliche emotionale oder fachliche Botschaft (Value

) und die tatsächliche emotionale oder fachliche Botschaft (Value ![]() ).

).

![]()

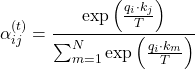

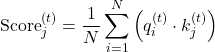

Der Attention-Mechanismus (Die skalierte Aufmerksamkeit)

Um zu berechnen, wie viel Aufmerksamkeit (![]() ) Person

) Person ![]() der Person

der Person ![]() schenkt, wird das Skalarprodukt aus Query und Key gebildet. Dieser Wert wird durch die Temperatur

schenkt, wird das Skalarprodukt aus Query und Key gebildet. Dieser Wert wird durch die Temperatur ![]() (den Skalierungsfaktor) geteilt, um ‚Groupthink‘ zu verhindern, und anschließend durch die Softmax-Funktion in einen Prozentwert zwischen 0 und 1 umgewandelt.

(den Skalierungsfaktor) geteilt, um ‚Groupthink‘ zu verhindern, und anschließend durch die Softmax-Funktion in einen Prozentwert zwischen 0 und 1 umgewandelt.

Die holistische Zielfunktion (Energie des Collective Mind)

Der Agile Coach (bzw. der Optimierungs-Algorithmus) versucht in der Retrospektive, die Gesamtenergie des Systems zu minimieren. Die Energie setzt sich zusammen aus der äußeren Arbeitslast (![]() ), der sozialen Reibung (

), der sozialen Reibung (![]() ), abzüglich der konstruktiven Synergie (

), abzüglich der konstruktiven Synergie (![]() ). Sowie der Burnout-Strafe (

). Sowie der Burnout-Strafe (![]() ), die das System zwingt, auf psychologische Gesundheit zu achten.

), die das System zwingt, auf psychologische Gesundheit zu achten.

![]()

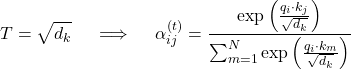

Die Temperatur des Netzwerks (Der Skalierungsfaktor)

In der statistischen Physik (und in der Psychologie) bestimmt die Temperatur ![]() , wie ‚chaotisch‘ (offen für Neues) oder ’starr‘ (Diktatur / Groupthink) ein System ist. Die Erfinder des Attention-Mechanismus definierten diese Temperatur mathematisch als die Wurzel aus der Anzahl der Dimensionen des Key-Vektors (

, wie ‚chaotisch‘ (offen für Neues) oder ’starr‘ (Diktatur / Groupthink) ein System ist. Die Erfinder des Attention-Mechanismus definierten diese Temperatur mathematisch als die Wurzel aus der Anzahl der Dimensionen des Key-Vektors (![]() ). Diese Skalierung kühlt das System herunter und verhindert, dass das Skalarprodukt bei hochdimensionalen Vektoren explodiert und die Softmax-Funktion nur noch extremistische 100%-zu-0%-Entscheidungen trifft.

). Diese Skalierung kühlt das System herunter und verhindert, dass das Skalarprodukt bei hochdimensionalen Vektoren explodiert und die Softmax-Funktion nur noch extremistische 100%-zu-0%-Entscheidungen trifft.

Die Burnout-Strafe (Der psychologische Schutzmechanismus)

Die Burnout-Energie bestraft das System mathematisch extrem hart, wenn der Stress eines Teammitglieds über Null steigt oder die Motivation unter Null fällt. (Der Faktor 2 fungiert als starkes Gewicht für diesen Schmerz). Um das Team jedoch zur inhaltlichen Arbeit zu zwingen, haben wir die Accountability-Strafe (den Fokus-Fix) in diesen Term integriert. Wenn der Fokus nun unter 0 fällt (die Leute sich also geistig ausklinken), wird das ebenfalls als harte Strafe auf die Energie addiert.

![]()

(Zur mathematischen Logik: Da Motivation und Fokus im Fehlerfall negative Werte annehmen, z.B. -0.5, sorgt das Minuszeichen in der Formel (![]() ) dafür, dass die Gesamtenergie als „Schmerz“ ansteigt).

) dafür, dass die Gesamtenergie als „Schmerz“ ansteigt).

Das Zustands-Update (Veränderung durch Interaktion)

Der gesamte Einfluss (![]() ), der auf Person

), der auf Person ![]() einprasselt, ist die Summe aller Botschaften (

einprasselt, ist die Summe aller Botschaften (![]() ), gewichtet mit der jeweiligen Aufmerksamkeit (

), gewichtet mit der jeweiligen Aufmerksamkeit (![]() ). Da Persönlichkeit und Werte konstant sind, verändert dieser Einfluss (multipliziert mit einer Lernrate

). Da Persönlichkeit und Werte konstant sind, verändert dieser Einfluss (multipliziert mit einer Lernrate ![]() ) nur den Stimmungs-Teilvektor (

) nur den Stimmungs-Teilvektor (![]() ) für den nächsten Tag. Die

) für den nächsten Tag. Die clip-Funktion hält die Werte im definierten Rahmen von -1 bis 1.

![]()

![]()

Score

Score, der in den Abbildungen angezeigt wird:

Anhang 2

Zusammenhang zwischen der Collective Mind Analyse über Ähnlichkeitsmatrizen und dem hier vorgestellten QKV Mechanismus

Den Collective Mind über Ähnlichkeitsmatrizen habe ich in dem Blog ‚AI & M 4.0: Markus Lanz vom 30. Mai 2024: Eine Collective Mind Analyse‘ vom Juni 2024 vorgestellt.

Dort interpretiere ich den Eigenvektor als Richtung und den Eigenwert als Stärke des Collective Mind.

Die Ähnlichkeitsmatrix = Die unkalibrierte Attention-Matrix (![]() )

)

Die Ähnlichkeitsmatrix misst, wie ähnlich das Gesprochene von Person ![]() und Person

und Person ![]() ist.

ist.

Der Kern der Attention-Formel ist das Skalarprodukt: ![]() .

.

Ein Skalarprodukt (Dot Product) in der linearen Algebra ist mathematisch gesehen nichts anderes als ein Maß für Ähnlichkeit (unkalibrierte Kosinus-Ähnlichkeit).

-

Ähnlichkeitsmatrix

, wobei ein Eintrag

, wobei ein Eintrag  die Ähnlichkeit zwischen der Aussage von

die Ähnlichkeit zwischen der Aussage von  und

und  ist.

ist. -

Attention: Matrix

, wobei ein Eintrag

, wobei ein Eintrag  das Skalarprodukt aus der Query von

das Skalarprodukt aus der Query von  und dem Key von

und dem Key von  ist.

ist.

Der Zusammenhang: Der QK-Mechanismus berechnet in jeder Schicht eines neuronalen Netzes, das was in der Ähnlichkeitsmatrix berechnet wird: Der QK-Mechanismus ist also eine gigantische Ähnlichkeitsmatrix.

Der Eigenvektor = Der Steady State der Kommunikation

Was passiert mathematisch, wenn ein agiles Team oder Gruppe über eine bestimmte Zeit hinweg iterativ kommuniziert? Person A beeinflusst Person B, Person B beeinflusst Person C, usw. Mathematisch bedeutet das, dass man den Zustandsvektor des Teams (![]() ) immer wieder mit der Ähnlichkeitsmatrix (

) immer wieder mit der Ähnlichkeitsmatrix (![]() ) multipliziert:

) multipliziert:

![]()

In der linearen Algebra gibt es dafür einen Namen: Die Vektoriteration (oder von-Mises-Iteration / Power Method). Wenn man einen Vektor immer wieder mit derselben Matrix multipliziert, konvergiert dieser Vektor unweigerlich gegen den dominanten Eigenvektor der Matrix!

-

Die Ähnlichkeitsmatrix Perspektive: Der Eigenvektor ist die ‚Richtung‘ des Collective Mind.

-

Die KI-Perspektive: In einem Transformer-Netzwerk (wie ChatGPT, Gemini, Claude, usw. ) werden Informationen durch dutzende übereinanderliegende Attention-Schichten gepumpt. Forscher haben herausgefunden, dass diese Netzwerke oft ein Verhalten zeigen, das an PageRank (den alten Google-Such-Algorithmus) oder Markov-Ketten erinnert. Wenn das Netzwerk iteriert, konvergieren die Bedeutungen der Wörter (oder in unserem Fall: die Meinungen der Teammitglieder) in Richtung eines gemeinsamen Konsenses. Dieser Konsens ist mathematisch exakt der Eigenvektor der Attention-Matrix! Der Eigenvektor berechnet voraus, auf welchen „Attraktor“ (welchen endgültigen Konsens) dieses Team zusteuern würde, wenn sie unendlich lange weiterdiskutieren.

Der Eigenwert = Die Temperatur (Softmax-Schärfe)

Auch der Eigenwert als ‚Stärke‘ des Collective Mind interpretiert spiegelt sich 1:1 in der KI wider!

-

Ein hoher Eigenwert im Ähnlichkeitsmatrix Modell bedeutet: Die Gruppe ist extrem eng miteinander korreliert (alle reden über dasselbe, hohe Ähnlichkeit). Der Collective Mind hat eine massive Anziehungskraft.

-

In der Attention-Formel regelt man diese ‚Stärke‘ über den Skalierungsfaktor (

) in der Softmax-Funktion, die ähnlich wie der Boltzmann Verteilung der Physik aufgebaut ist. Physiker nennen das die Temperatur des Systems. Ist die Stärke hoch (niedrige Temperatur), ist die Matrix extrem scharf – das Team folgt blind dem dominanten Eigenvektor (Gruppendenken / Groupthink). Ist die Stärke gering (hohe Temperatur), ist die Matrix flacher – das Team ist diverser, aber der Collective Mind ist schwächer.

) in der Softmax-Funktion, die ähnlich wie der Boltzmann Verteilung der Physik aufgebaut ist. Physiker nennen das die Temperatur des Systems. Ist die Stärke hoch (niedrige Temperatur), ist die Matrix extrem scharf – das Team folgt blind dem dominanten Eigenvektor (Gruppendenken / Groupthink). Ist die Stärke gering (hohe Temperatur), ist die Matrix flacher – das Team ist diverser, aber der Collective Mind ist schwächer.

Wo der QKV-Mechanismus das Ähnlichkeitsmatrix Modell erweitert:

Der QKV-Mechanismus der KI erweitert das Ähnlichkeitsmatrix Modell um zwei entscheidende Aspekte:

Die Matrix wird asymmetrisch (Q vs. K)

Ähnlichkeiten im Ähnlichkeitsmatrix Modell sind symmetrisch (Mein Text ist deinem so ähnlich wie deiner meinem). Eine solche Matrix (![]() ) hat sehr brave, orthogonale Eigenvektoren.

) hat sehr brave, orthogonale Eigenvektoren.

Menschen sind aber nicht symmetrisch! Der Junior-Entwickler achtet vielleicht sehr stark auf die Aussagen des Senior-Architekten, aber der Senior ignoriert den Junior. Indem die KI die Eigenschaften nicht direkt vergleicht, sondern sie durch zwei getrennte Filter jagt (![]() = „Was ich suche“ und

= „Was ich suche“ und ![]() = „Was ich anbiete“), entsteht eine asymmetrische, gerichtete Matrix. Das bildet Machtgefälle, Respekt und echte Hierarchien im Collective Mind ab.

= „Was ich anbiete“), entsteht eine asymmetrische, gerichtete Matrix. Das bildet Machtgefälle, Respekt und echte Hierarchien im Collective Mind ab.

Die Trennung von Beziehung und Botschaft (Value)

Im Ähnlichkeitsmatrix Modell ist das Gesprochene gleichzeitig die Verbindung und der Inhalt.

Der Attention-Mechanismus trennt das elegant:

-

und

und  berechnen nur die Ähnlichkeitsmatrix (Wer hört wem wie stark zu?). Das ist im Ähnlichkeitsmatrix Modell der Eigenvektor.

berechnen nur die Ähnlichkeitsmatrix (Wer hört wem wie stark zu?). Das ist im Ähnlichkeitsmatrix Modell der Eigenvektor. -

Der Value (

) ist die eigentliche Information, die zusätzlich getrennt durch dieses Netzwerk fließt.

) ist die eigentliche Information, die zusätzlich getrennt durch dieses Netzwerk fließt.

Fazit

Das Modell des Collective Mind, das über Eigenvektoren von Ähnlichkeitsmatrizen aufgebaut ist, entspricht dem mathematische Äquivalent einer! ‚Attention‘-Schicht. Die KI-Forschung der letzten Jahre legt nahe, dass genau dieser Mechanismus – das kontinuierliche Updaten von Zuständen basierend auf Ähnlichkeits-Matrizen – universell ist. Es ist der Code, mit dem das Universum Kontexte bildet: Egal ob es darum geht, wie Wörter in einem Satz ihren Sinn finden, wie Proteine sich anhand ihrer Aminosäuren falten, oder auf welchen ‚Eigenvektor‘ (Konsens) sich ein agiles Team nach drei Sprints einigt.

Literatur

[1] A. Vaswani et. al. (2017) Attention is all you need, aktuelle Version aus dem Jahre 2023: arXiv:1706.03762

[2] J. Köhler und A. Oswald (2009) Die Collective Mind Methode, Springer Verlag

[3] T. Zaklama et. al. (2026) Large Electron Model: A Universal Ground State Predictor, arXiv:2603.02346v1