Kürzlich erschien ein offener Brief zum Thema ‚Pausieren von gigantischen AI-Experimenten‘ à la GPT-3 oder GPT-4 [1].

Der Brief wurde inzwischen von mehr als 30.000 Personen unterschrieben. Er begründet sein Anliegen eines halbjährigen Aussetzens von AI-Groß-Entwicklungstätigkeiten mit folgendem Satz:

“This does not mean a pause on AI development in general, merely a stepping back from the dangerous race to ever-larger unpredictable black-box models with emergent capabilities.”

Es geht die Angst vor ‚emergenten Fähigkeiten‘ um. – An anderer Stelle wird von einer ‚Gottgleichen‘ KI gewarnt, die die Menschheit zerstören könnte [2].

Diese Sorgen mögen berechtigt sein, umso mehr, als man beobachten kann, wie lange sich die EU schon bemüht, den längst fälligen EU AI ACT als EU-Gesetz zu verabschieden [3].

In diesem Blog geht es jedoch nicht um diese Sorge oder Angst, sondern um das Thema Emergenz, das offensichtlich solche ‚Wunder‘ wie das der „Sparks of Artificial General Intelligence: Early experiments with GPT-4” [4] möglich macht. Die Intelligenz-Fähigkeiten von GPT-4, auch im Vergleich zu chatGPT/GPT-3.x, sind sensationell, gleichgültig, ob es um Mathematik, Musik, Bilderzeugung, Sprache und Logik und vielem mehr geht. – In nicht wenigen Fällen zeigt GPT-4 Intelligenz-Fähigkeiten, die überhaupt nicht trainiert worden sind. – Also klare Zeichen von emergenten Eigenschaften.

In Wikipedia wird Emergenz wie folgt definiert: „Emergenz (lateinisch emergere „Auftauchen“, „Herauskommen“, „Emporsteigen“) bezeichnet die Möglichkeit der Herausbildung von neuen Eigenschaften (Systemeigenschaften) oder Strukturen eines Systems infolge des Zusammenspiels seiner Elemente.“ [5]. Emergenz ist auch direkt mit dem Begriff der Selbstorganisation verbunden. Selbstorganisierte Systeme zeigen Emergenz bzw. emergente Eigenschaften. Auf der Basis dieser Definition wimmelt es in der Natur und damit in der Mathematik, den Naturwissenschaften/ Psychologie und den Sozialwissenschaften nur so von emergenten Eigenschaften, Strukturen oder Systemen.

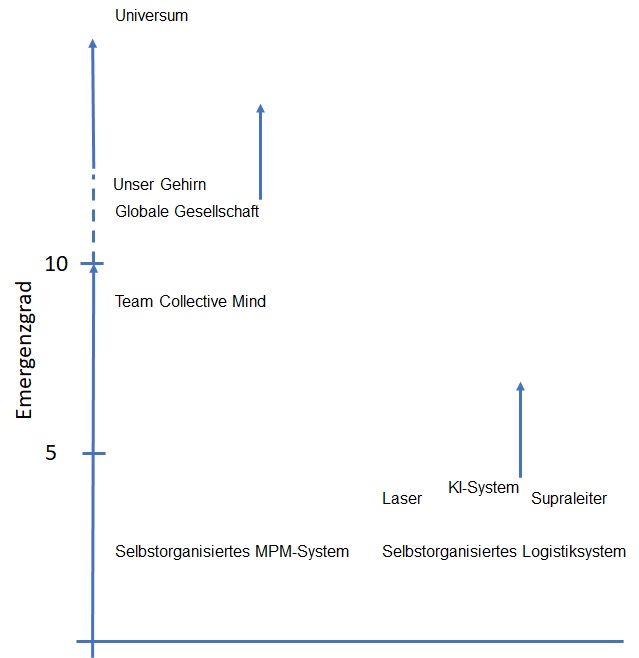

In [6] wird auch deshalb zwischen schwacher und starker Emergenz unterschieden. Starke Emergenz liegt im Falle des Lebens vor, das aus Atomen oder Molekülen emergiert. – Oder, im Falle unseres Bewusstseins, das aus der materiellen Struktur unseres Gehirns emergiert. Die meisten anderen überraschenden Eigenschaften von Viel-Agenten Systemen wie zum Beispiel die Supraleitung, die Farbe von Gold, der Collective Mind eines Teams oder die Kultur einer Organisation werden eher der schwachen als der starken Emergenz zugeordnet. Ich halte die Unterscheidung für wenig sinnvoll.- Entscheidend für die Emergenz ist vielmehr, dass das durch die Wechselwirkung von Agenten entstehende Systeme Eigenschaften zeigt, die sich nicht aus den Eigenschaften der Agenten ableiten lassen. In [7] wird deshalb für die Beschreibung von Large Language Model’s bezüglich Emergenz eine Definition verwendet, die die obige Definition aus [5] weiterführt:

„Emergence is when quantitative changes in a system result in qualitative changes in behavior.”

Im Falle von Large Language Models (LLM) gibt es mehrere quantitative Änderungen, die qualitative Veränderung hervorrufen: u.a. Anzahl der Parameter (Neuronen), Menge der Daten und die Trainingszeit. Aber auch die Architektur der LLM’s spielt eine entscheidende Rolle: u.a. das Transformer/Decoder Design, der Attention Mechanismus, usw.. So zeigt GPT-3 bei etwa 10 hoch 22 (10 Trilliarden) Floating Point Operations (FLOPs) als Maß für die Trainingszeit und 13 Milliarden Parametern einen sprunghaften Anstieg der sogenannten few-shoot prompting Genauigkeit.- Also nach einigen wenigen Lerndaten meistert das AI-System ähnliche Aufgabenstellungen. – Dieser Übergang entspricht einem Phasenübergang. – Ganz ähnlich zu der gesellschaftliche Resonanz für AI-System, die mit dem Erscheinen des einfach zu bedienenden chatGPT sprunghaft emergierte.

Für die Beschreibung emergenten Systemverhaltens wurde in der Wissenschaftsgeschichte sehr oft der Nobelpreis vergeben: Es geht darum, diejenigen quantitativen Parameter ausfindig zu machen, die einen qualitativen Unterschied machen. Und dies ist meistens sehr schwierig, da man den Parametern nicht ansieht, ob sie in ihrer Zusammenstellung einen Unterschied machen. – Der qualitative Unterschied lässt sich also nicht auf die quantitativen Unterschiede in den Parametern reduzieren.

Jedoch wurde auch in der Geschichte der Wissenschaft aus dem Unverständnis der Emergenz eine unsinnige Spaltung in reduktionistische Wissenschaften und nicht-reduktionistische (holistische) Wissenschaften [9] vorgenommen. Hiernach wurde zum Beispiel die Physik als reduktionistische Wissenschaft angesehen, da angeblich alle System-Eigenschaften in der Physik auf die Eigenschaften der Agenten (z.B. Elementarteilchen, Atome) zurückgeführt werden, also reduziert werden. Die Sozialwissenschaft mit der Soziologie à la Luhmann wurde zum Beispiel als holistische Wissenschaft wahrgenommen, da Luhmann, die Eigenschaften des sozialen Systems nicht auf die Menschen zurückführte, sondern dem System eine Eigenständigkeit zuerkannte.

Diese teilweise immer noch vorhandene naive Sicht des Gegensatzpaares Reduktionismus-Holismus wird durch das Auftauchen von GPT-4, aber auch schon durch die Erfahrungen mit chatGPT, kräftigst widerlegt: Die technischen Systeme chatGPT/GPT-3.x und chatGPTplus/GPT-4 zeigen mit ihrer Intelligenz eine für alle erfahrbare Emergenz. Diese AI-Systeme wurden auf der Basis bestimmter Daten-Parameter (u.a. Anzahl der Neuronen, Zeit des Trainings, Menge der Trainingsdaten) sowie bestimmten Architektur-Parameter (u.a. Transformer/Decoder und Attention-Mechanismus) mehr oder weniger gezielt kombiniert und es entstanden bei einer bestimmten Kombination dieser Parameter „wie durch ein Wunder“ emergente Intelligenz-Eigenschaften. – Es ist zu vermuten, dass bei Wegnahme z.B. der Attention-Eigenschaft, die emergente Eigenschaft der Intelligenz verschwindet, auch wenn die gigantische Skalierung bleibt.

Deswegen sind die emergenten AI-Eigenschaft jedoch nicht weniger wunderbar.

Dieses Beispiel belegt äußerst eindrucksvoll, dass die Natur, auch wenn sie in Form einer Technologie daherkommt, alle Ingredienzien für starke Emergenz enthält. – Wir ‚finden‘ diese Ingredienzien ‚lediglich‘.

Agent Based Modeling (ABM) spielt beim Auffinden dieser Eigenschaften eine prominente Rolle, auch wenn diese Rolle selbst in der Wissenschaft im Verhältnis zur Bedeutung nur wenigen bekannt sein dürfte. Unlängst hat das Santa Fe Institute neben Netlogo das ABM-Python-Framework MESA als Lecture aufgenommen [10]. Diese Lecture bildet mit moderner Technik das ABM des 25 Jahre alten Buches über ‚Growing Artificial Societies‘ von Epstein und Axtell nach [11]. Epstein und Axtell zeigen, wie man mit einfachen lokalen Agenten-Parametern die emergenten System-Eigenschaften von Gesellschaften erzeugen kann. – Der Überraschungseffekt ist nicht selten groß: So beeinflusst zum Beispiel die Fähigkeit des Sterbens oder der Reproduktion von Agenten ganz erheblich die emergenten Eigenschaften der ABM Ökonomie: Diese Modell-Eigenschaften sind nämlich notwendig, damit sich überhaupt sogenannte Nicht-Gleichgewichts-Handelsmärkte ausbilden können, die mit realen Märkten sehr gut übereinstimmen. – Das immer noch in der Gesellschaft vorherrschende neoklassische Verständnis der Gleichgewichts-Ökonomie kennt solche Zusammenhänge nicht.

In den folgenden Blogbeiträgen beschäftige ich mich mit der Suche nach den Parametern, die das emergente Teamverhalten Collective Mind hervorrufen. Im Management 4.0 gehen wir davon aus, dass die Parameter der Theorie der Selbstorganisation (Rahmen-Parameter, Kontroll-Parameter und Ordnungs-Parameter) die entscheidenden Parameter sind, die emergentes Teamverhalten hervorbringen. Wir kennen diese Parameter (vermutlich) auch schon, jedoch nicht in hinreichend formalisierter ABM Sprache. Die in vorhergehenden Blog-Beiträgen unter Verwendung von Natural Language Processing abgeleitete Similarity-Matrix des Collective Mind (Collective Mind Operator) ist lediglich ein phänomenologisches Modell (siehe Blog-Beitrag vom April und Juni 2022). – Der Collective Mind Operator kann in der Teampraxis sehr gut den Collective Mind messen, er sagt jedoch leider nichts darüber aus, wie der Collective Mind emergiert. Hierzu benötigen wir die formalisierten ABM-Parameter, die die Collective Mind Emergenz hervorbringen. – Die Suche nach diesen formalisierten Parametern ist kein Selbstzweck, denn die Wissenschaftsgeschichte hat gezeigt, dass die Kenntnis der formalisierten Parameter recht oft mit großen Erkenntnisgewinnen verbunden ist. – Die GPT-Geschichte ist der sichtbarste Beweis hierfür.

Der Übergang zur Python-Technologie mit MESA-Python eröffnet auch recht einfach die Möglichkeit intelligente Agenten auf der Basis von chatGPT anzubinden. Das werde ich nicht tun, jedoch hat die Entwicklung hierzu, wie in einem meiner letzten Blogs prognostiziert, schon begonnen. Die Stanford University hat zusammen mit Google eine auf dem Computerspiel ‚The Sims‘ basierendes ABM erstellt, in dem 25 Agenten ihre Intelligenz von chatGPT erhalten [12]. Die Agenten haben eine ‚Gehirn-Architektur‘ aus Langzeit- und Kurz-Zeitgedächnis, dessen kognitive Intelligenz von chatGPT kommt. Die Agenten verfügen zusätzlich über einen sogenannten ‚reflection tree‘, der der Ziel-Hierarchie bzw. der Dilts Pyramide von Management 4.0 sehr nahe kommt [13].- Die Ebenen Identität, Fähigkeiten und Verhalten sowie Kontext (Beobachtung) sind schon vorhanden. – Diese und weitere Ebenen können sicherlich noch ausgebaut werden.

Damit sind die Agenten in der Lage einen individuellen kognitiven PDCA-Zyklus durchzuführen, der ‚reflektiertes‘ Handeln erlaubt.

Es besteht auch die Möglichkeit, dass sich Menschen aktiv in dieses Handeln künstlicher Agenten einbringen können. Damit ist es zum Beispiel möglich hybride Universen aus AI und Menschen zu bilden.

Man stelle sich ein Anwendungsbeispiel von vielen vor: Ein Projektleiter soll ein Projekt durchführen. Er lässt das Projekt zum Test vorab in der künstlichen Welt durchführen und erhält so Hinweise auf seine Durchführbarkeit. – Oder er lässt parallel zur realen Welt eine künstliche Welt mitlaufen, in die die Daten der realen Welt synchron eingespeist werden, um Forecasting zu betreiben.

In [12] wird berichtet, dass das Handeln der künstlichen Agenten von Menschen auf ‚Menschen-Ähnlichkeit‘ überprüft wurde. Das emergierende ‚believable behavior‘ der Agenten und des emergierenden sozialen Systems wird von den Evaluationspersonen, trotz einiger Fehler, als sehr hoch eingestuft.

Das nächste Wunder geschieht schon!

[1] Future of Life Institute (2023) Pause giant AI Experiments, https://futureoflife.org/open-letter/pause-giant-ai-experiments/, zugegriffen am 22.04.2023

[2] Barkey S (2023) Kurz vor dem Durchbruch: „Gottgleiche“ KI könnte laut Experte Menschheit zerstörenhttps://www.berliner-zeitung.de/news/agi-kurz-vor-durchbruch-gottgleiche-ki-koennte-laut-experte-ian-hogarth-menschheit-zerstoeren-kuenstliche-allgemeine-intelligenz-li.339062, zugegriffen am 22.04.2023

[3] EU (2023) EU AI Act, https://artificialintelligenceact.eu/, zugegriffen am 22.04.2023

[4] Bubeck S et al. (2023) Sparks of Articial General Intelligence: Early experiments with GPT-4, arXiv:2303.12712v3 [cs.CL] 27 Mar 2023, zugegriffen am 22.04.2023

[5] Wikipedia (2023) Emergenz, https://de.wikipedia.org/wiki/Emergenz, zugegriffen am 25.04.2023

[6] Greve J, Schnabel A (Herausgeber) (2011) Emergenz: Zur Analyse und Erklärung komplexer Strukturen, suhrkamp taschenbuch wissenschaft

[7] Wi J et al. (2022) Emergent Abilities of Large Language Models, in Transactions on Machine Learning Research 08/2022, arXiv:2206.07682v2 [cs.CL] 26 Oct 2022

[8] DALL-E (2023) https://openai.com/product/dall-e-2, zugegriffen am 03.05.2023

[9] Wikipedia (2023) Reduktionismus, https://de.wikipedia.org/wiki/Reduktionismus, zugegriffen am 25.04.2023

[10] Complexity Explorer (2023) MESA-Python Lecture, https://www.complexityexplorer.org/courses/172-agent-based-models-with-python-an-introduction-to-mesa/segments/17326, Santa Fe Institute, zugegriffen am 30.04.2023

[11] Epstein J M, Axtell R (1996) Growing Artificial Societies – Social Science from the Bottom Up, The Brookings Institution, Washington D.C.

[12] Park J S et. al. (2023) Generative Agents: Interactive Simulacra of Human Behavior, arXiv:2304.03442v1 [cs.HC] 7 Apr 2023

[13] Oswald A, Müller W (2019) Management 4.0 – Handbook for Agile Practices, Release 3.0, Verlag BoD, kindle edition