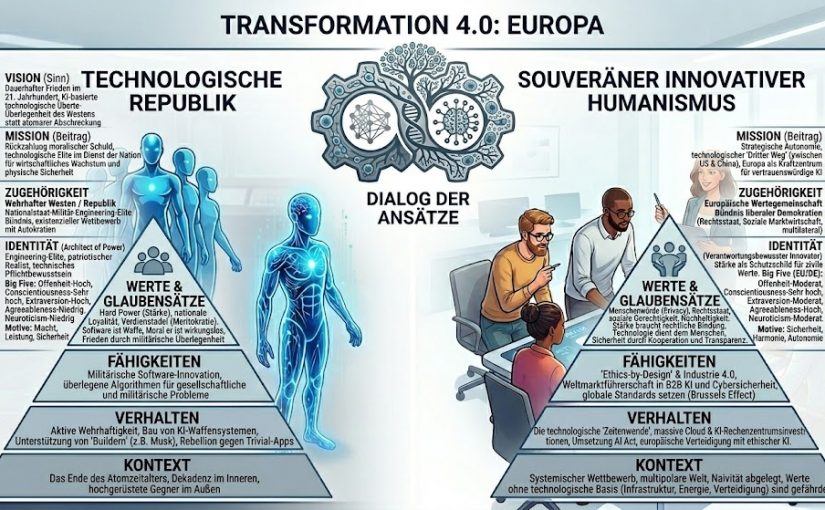

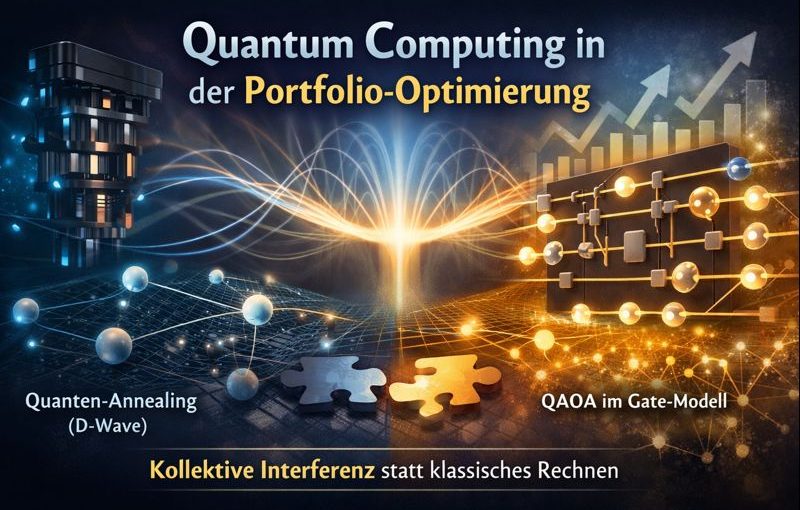

Kurzfassung: Die Firma Palantir hat mit ihrem am 18.04.2026 veröffentlichten Manifest ‚Technologische Republik‘ ein neues Selbstverständnis für die amerikanische Tech-Elite des Silicon Valley ausgerufen. Dieser Blog-Beitrag analysiert das Manifest mit verschiedenen KI-Systemen (ChatGPT, Claude, Mistral und Gemini) und liefert in einer aggregierter Dilts Pyramide die kollektive Persönlichkeit dieses neuen Selbstverständnisses. Als Gegen-Entwurf wird eine neue kollektive Persönlichkeit Europas entwickelt und skizziert welche Schwerpunkte eine Transformation in Richtung dieses neuen Europas setzt.

Der vorliegende Blog-Beitrag wurde mittels Gemini und den weiteren KI-Systeme Mistral, Claude und ChatGPT erstellt.

Die amerikanische Firma Palantir hat am 18.04.2026 ihr Manifest zur Neuausrichtung der westlichen Welt auf X veröffentlicht [0]. Damit hat sie uns Europäern einen großen Gefallen getan: Die Unsicherheit, wohin die USA mit ihren Tech-Milliardären steuert, ist verflogen. Wer jetzt die Zeichen der Zeit nicht verstanden hat, dem fehlt es entweder an notwendigen mentalen Fähigkeiten oder er unterstützt die in dem Manifest zum Ausdruck kommende Haltung.

Der Spiegel hat unlängst eine zutreffende Einschätzung des Manifestes veröffentlicht [1].

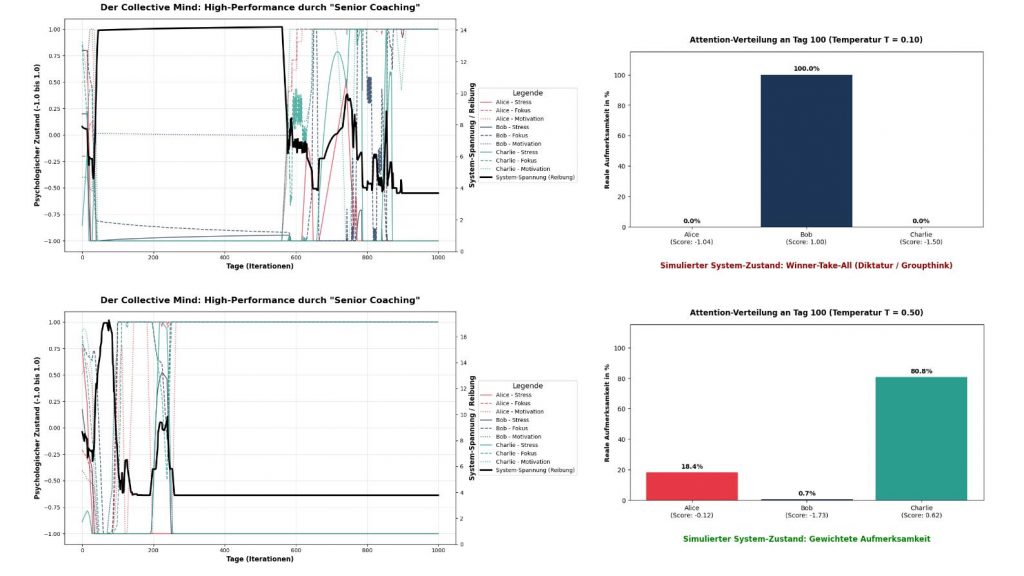

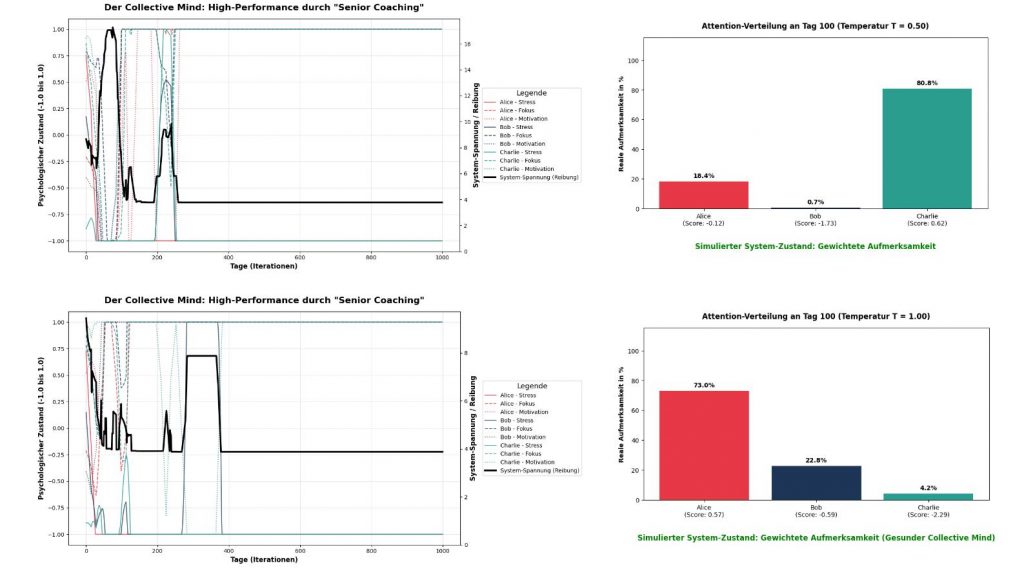

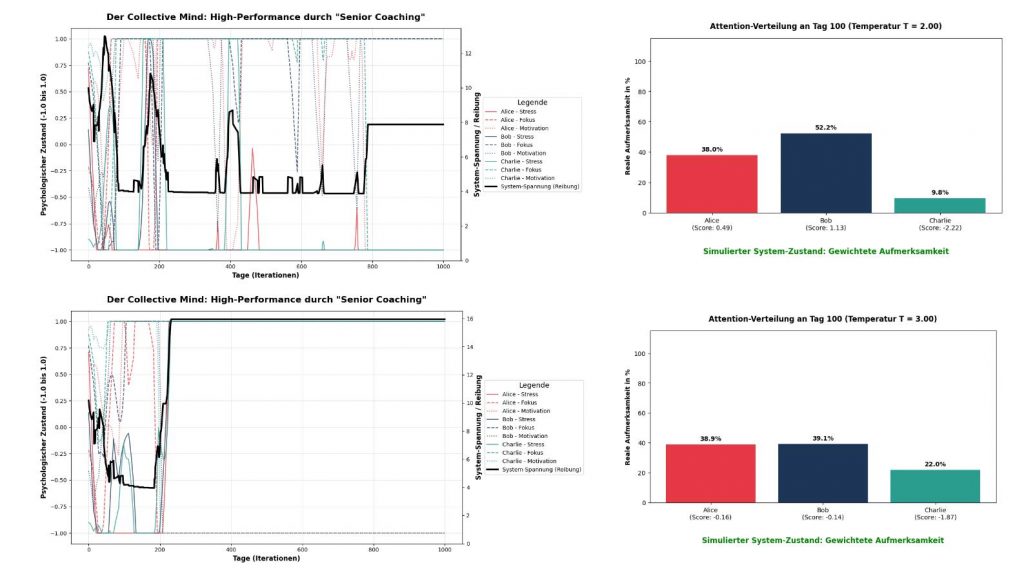

Ich unterbreche mit diesem Beitrag meine aktuelle Blog-Reihe ‚Attention Collective Mind‘, da ich die in dem Manifest zum Ausdruck kommende innere Haltung für eine sehr konkrete Bedrohung Europas verstehe.

Palantir setzt u.a. KI in seiner Software ein: Es liegt also nahe, verschiedene KI-Systeme nach ihrer ‚Meinung‘ zu dem Manifest zu befragen.

Im Anhang 1 ist der Prompt enthalten, den ich an vier KI-Systeme (Gemini, Mistral, Claude und ChatGPT) geschickt habe, sowie die jeweiligen Antworten. – Diese Antworten spiegeln mein Verständnis des Palantir Manifests wieder: Die Antworten von Gemini, ChatGPT und Mistral sind sehr umfangreich und treffen meine Erwartung. Die Antwort von Claude fällt im Vergleich gegenüber den anderen drei KI-Systemen in Qualität und Umfang deutlich ab.

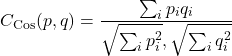

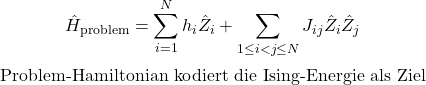

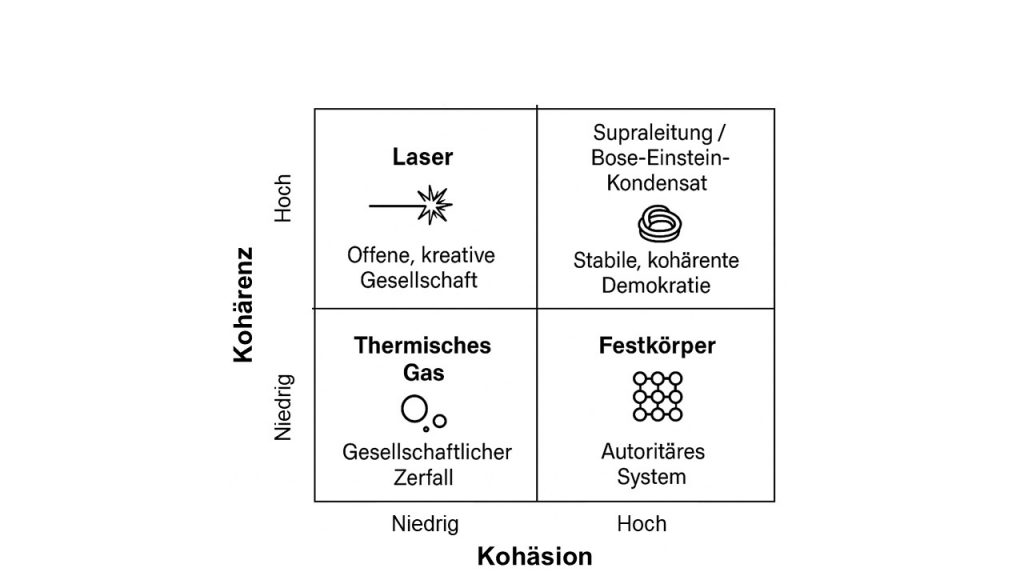

Ich verwende im Folgenden das Management 4.0 Transformation Modell [2], um für Europa auf dieser Basis einen Gegen-Entwurf zur Palantir Kultur zu skizzieren. Die Vorgehensweise des Management 4.0 Transformation Modell ist hierfür wie folgt:

Zuerst ermittele ich mit Hilfe von Gemini Pro pro KI-Analyse eine Dilts Pyramide, die sich aus den Antworten der vier KI Systeme zum Palantir Manifest ergibt. Diese vier Dilts Pyramiden enthalten alle relevante Informationen der kollektiven Palentir Persönlichkeit: Vision, Mission, Zugehörigkeit, Identität (Big Five, Motive), Werte (Spiral Dynamics value meme) und Glaubenssätze, Fähigkeiten, Verhalten und Kontext. Sie liefern damit eine Struktur für einen europäischen Gegen-Entwurf.

Anschließend werden diese vier Dilts Pyramiden mittels Gemini Pro in eine aggregierte Dilts Pyramide des Palantir Manifestes zusammengefasst.

Es wird die angestrebte zukünftige, kollektive Persönlichkeit Europas in Form einer Dilts Pyramide ermittelt: Leitgedanke ist hierbei, dass sich diese kollektive Persönlichkeit (Kultur) im Machtgefüge der Welt behaupten muss und eine zu Europa passende Gegen-Kultur zur Palentir-Kultur entwickelt wird.

Es wird eine (oder ggf. mehrere) Transformation Dilts Pyramiden erstellt: Diese Dilts Pyramiden beleuchten den Weg von der aktuellen europäischen Kultur zur zukünftigen europäischen Kultur. Auch wenn eine Verhaltensveränderung sehr oft durch einen geeigneten System-Kontext hervorgerufen wird, so ist die Kenntnis der gesamten Dilts Pyramide entscheidend. Veränderungen insbesondere in den mittleren Ebenen, Identität sowie Werte und Glaubenssätze, entscheiden darüber, ob eine Veränderung nachhaltig wird.

Die nachfolgende Tabelle 1 fasst das Ergebnisse der vier KI Analysen zusammen. Für diese zusammenfassende Analyse habe ich Gemini Pro verwendet:

| Ebene | ChatGPT | Mistral | Claude | Gemini |

| Vision | Technologisch gestützte Macht-Demokratie; KI als Abschreckung für Frieden. | Technologische Hegemonie des Westens; zentralisierter, technischer Staat. | Existentielle Verteidigung des Westens in einer feindseligen Weltordnung. | Post-Atomare Ordnung; Sicherung des Friedens durch Software-Souveränität. |

| Mission | Verzahnung von Staat und Tech; Elite muss Landesverteidigung stützen. | Stärkung staatlicher Souveränität durch Kooperation mit Privat-Tech. | Selbstlegitimierung des Silicon Valley als nationaler Leistungsträger. | Ideologisches Rückgrat des Westens; Dienst an Volk, Sicherheit und Wachstum. |

| Zugehörigkeit | Politischer Realismus und Techno-Nationalismus. | Moderner militärisch-industrieller Komplex 2.0. | Strategische Interessenpolitik; Realismus trifft Kulturkonservatismus. | Wehrhafter Neokonservatismus und technologischer Nationalismus. |

| Identität (Big Five & Motive) |

Strategischer Pflichtdenker O: Hoch, C: Sehr hoch, E: Mittel, A: Niedrig, N: Niedrig Motive: Kontrolle, Bedeutung. |

Hierarchischer Macher O: Hoch, C: Sehr hoch, E: Hoch, A: Niedrig, N: Niedrig Motive: Leistung, Macht, Sicherheit. |

Selbstbewusste O: Hoch, C: Hoch, E: Dominant, A: Niedrig, N: Niedrig Motive: Einfluss, Verantwortung. |

Homo O: Hoch, C: Sehr hoch, E: Hoch, A: Niedrig, N: Niedrig Motive: Macht, Leistung. |

| Werte & Glaubenssätze |

Werte: Stärke, Pflicht, Leistung. Glaube: Software ist die primäre Machtbasis. |

Werte: Disziplin, Sicherheit, Ordnung. Glaube: Technologie bestimmt das Schicksal. |

Werte: Macht, Verantwortung. Glaube: Stärke schützt; Kulturen sind ungleichwertig. |

Werte: Loyalität, Exzellenz, Hard Power. Glaube: Moral ohne Waffen ist wirkungslos. |

| Fähigkeiten | Strategische Macht-Projektion und Daten-Effizienz. | Entwicklung von KI-Waffensystemen; technokratische Führung. | Intellektuelle Diagnose des Verfalls; realpolitische Analyse. | Bau hochkomplexer Militär-Software; technologische Souveränität. |

| Verhaltensweisen | Rebellion gegen „App-Tyrannei“; Forderung nach Wehrpflicht. | Kampf gegen Dysfunktionalität; Unterordnung unter Staatsziele. | Kritik an Woke-Kultur; Fokus auf Hard Power statt Rhetorik. | National Service; Bau „besserer Gewehre“ (Software). |

| Kontext | Ein dekadentes Silicon Valley vor globalen Bedrohungen. | Eine Welt voller rationaler Gegner ohne ethische Skrupel. | Eine Welt der Systemrivalität und kulturellen Spaltung. | Ein globaler Wettbewerb, in dem Soft Power allein scheitert. |

Tabelle 1: Zusammenfassung der vier KI-Analysen des Palantir Manifestes auf der Basis der vier KI-Antworten (man siehe Anhang 1) als Dilts Pyramiden.

Die Ergebnisse in Tabelle 1 zeigen eine hohe Übereinstimmung mit gewissen unterschiedlichen Präferenzen der KI-Systeme. Aus diesem Grunde habe ich Gemini Pro gebeten, unter Verwendung der vier KI-Analysen und möglichen Rückgriffen auf das Palantir Manifest, eine aggregierte Dilts Pyramide zu erstellen. Tabelle 2 zeigt diese aggregierte Dilts Pyramide. Meines Erachtens gibt diese Tabelle das Palantir Manifest auf sehr prägnante Weise wieder.

| Ebene der Pyramide | Beschreibung / Charakterisierung des Manifests |

| 1. Vision (Sinn) | Die Technologische Republik: Ein dauerhafter Frieden im 21. Jahrhundert, der nicht mehr auf atomarer Abschreckung, sondern auf technologischer (KI-basierter) Überlegenheit des Westens basiert. |

| 2. Mission (Beitrag) | Rückzahlung der moralischen Schuld: Die technologische Elite integriert sich wieder in den Dienst der Nation, um durch „Hard Power“ wirtschaftliches Wachstum und physische Sicherheit für die Bevölkerung zu garantieren. |

| 3. Zugehörigkeit | Der wehrhafte Westen / Die Republik: Ein System aus Nationalstaat, Militär und Engineering-Elite, das sich in einer existenziellen Rivalität mit autokratischen Gegnern befindet. |

| 4. Identität (Wer?) |

Der „Architect of Power“ (Die Engineering-Elite): Ein verantwortungsbewusster, patriotischer Realist, der technische Exzellenz als politische Verpflichtung versteht. • Big Five: • Motive: Macht (Einfluss), Leistung (Fortschritt), Sicherheit (Schutz). |

| 5. Werte & Glaubenssätze |

Werte: Hard Power (Stärke), nationale Loyalität, Verdienstadel (Meritokratie), Vergebung für Staatsdiener. Glaubenssätze: „Software ist die Waffe der Zukunft“; „Moral ohne Stärke ist wirkungslos“; „Frieden ist ein Produkt militärischer Überlegenheit“; „Kulturen sind nicht gleichwertig“. |

| 6. Fähigkeiten | Militärische Software-Innovation: Die Fähigkeit, komplexe gesellschaftliche und militärische Probleme (Kriminalität, Verteidigung) durch überlegene Algorithmen und KI effizienter zu lösen als der Staat allein. |

| 7. Verhalten | Aktive Wehrhaftigkeit: Bau von KI-Waffensystemen; Rebellion gegen „triviale“ App-Kultur (iPhone-Tyrannei); Forderung nach allgemeiner Dienstpflicht; Unterstützung von „Buildern“ wie Elon Musk. |

| 8. Kontext | Das Ende des Atomzeitalters: Eine Welt geprägt von Dekadenz im Inneren und technologisch hochgerüsteten Gegnern im Außen, in der die bisherige Friedensordnung zu zerbrechen droht. |

Tabelle 2: Diese Tabelle aggregiert und interpretiert die vier KI-Analysen in einer aggregierten Dilts Pyramide, erstellt von Gemini: Das Manifest lässt sich als „Technologischer Realismus“ zusammenfassen. Es bricht mit dem optimistischen, globalistischen und oft staatsfernen Ethos des klassischen Silicon Valley. Die Kernbotschaft ist: Der Westen ist nur so stark wie seine Software. Die Identität des „Machers“ wird hier mit der Identität des „Soldaten“ oder „Staatsdieners“ verschmolzen. Es ist ein Aufruf zur Abkehr von der „Dekadenz“ hin zu einer harten, technologisch fundierten Realpolitik. Das Menschenbild ist dabei fordernd: Der Einzelne schuldet dem Staat Dienst, und der Staat schuldet dem Volk Stärke.

Ich habe Gemini Pro gebeten, mittels der Dilts Pyramide einen Gegen-Entwurf für Europa zu skizzieren. Ich nenne diesen Gegenentwurf ‚Souveräner Innovativer Humanismus‘:

| Ebene | Beschreibung der europäischen / deutschen Position |

| 1. Vision | Souveräner Innovativer Humanismus: Eine Welt, in der Technologie die Freiheit und Würde des Einzelnen schützt und demokratische Gesellschaften durch technologische Exzellenz und ethische Standards stabilisiert werden. |

| 2. Mission | Strategische Autonomie: Den technologischen „Dritten Weg“ zwischen US-Datenkapitalismus und chinesischem Staatsautoritarismus sichern. Europa als Kraftzentrum für vertrauenswürdige KI und industrielle Souveränität. |

| 3. Zugehörigkeit | Die Europäische Wertegemeinschaft: Ein Bündnis aus liberalen Demokratien, das auf dem Rechtsstaat, der Sozialen Marktwirtschaft und multilateraler Kooperation basiert. |

| 4. Identität |

Der „Verantwortungsbewusste Innovator“: Ein Akteur, der Stärke nicht als Selbstzweck sieht, sondern als Schutzschild für zivile Werte. • Big Five (EU/DE): • Motive: Sicherheit, Harmonie, Autonomie. |

| 5. Werte & Glaubenssätze |

Werte: Menschenwürde (Privacy), Rechtsstaatlichkeit, soziale Gerechtigkeit, Nachhaltigkeit. Glaubenssätze: „Stärke braucht rechtliche Bindung“; „Technologie muss dem Menschen dienen, nicht umgekehrt“; „Echte Sicherheit entsteht durch Kooperation und Transparenz“. |

| 6. Fähigkeiten | „Ethics-by-Design“ & Industrie 4.0: Weltmarktführerschaft in industrieller KI (B2B), Cybersicherheit und der Fähigkeit, globale Standards zu setzen (der sog. „Brussels Effect“, wie beim AI Act). |

| 7. Verhalten | Die technologische „Zeitenwende“: Massive Investitionen in europäische Infrastruktur (Cloud, KI-Rechenzentren); Umsetzung des AI Act; Aufbau einer europäischen Verteidigungsfähigkeit, die KI ethisch integriert. |

| 8. Kontext | Systemischer Wettbewerb: Eine multipolare Welt, in der Europa seine Naivität abgelegt hat und erkennt, dass Werte ohne technologische Basis (Infrastruktur, Energie, Verteidigung) nicht überlebensfähig sind. |

Tabelle 3: Zukünftige Dilts Pyramide Europa’s als Ziel einer gesellschaftlichen Transformation.

Wenn man beide Pyramiden vergleicht, sieht man den fundamentalen Konfliktpunkt:

-

Palantir argumentiert: Macht schafft Realität: Zuerst die Software/Waffe, dann die Moral.

-

Europa argumentiert: Werte legitimieren Macht: Zuerst der Rechtsrahmen, dann die Anwendung.

-

Deutschland steckt in der Dilts-Pyramide oft auf der Ebene der Verhaltensweisen fest (Bürokratie, langsame Digitalisierung), während die Identität („Exportweltmeister/Ingenieursnation“) ins Wanken gerät. Die Antwort auf Palantir müsste für Deutschland bedeuten, die Ebene der Fähigkeiten radikal zu modernisieren (Software-Kompetenz), ohne die Ebene der Werte (Rechtsstaatlichkeit) aufzugeben.

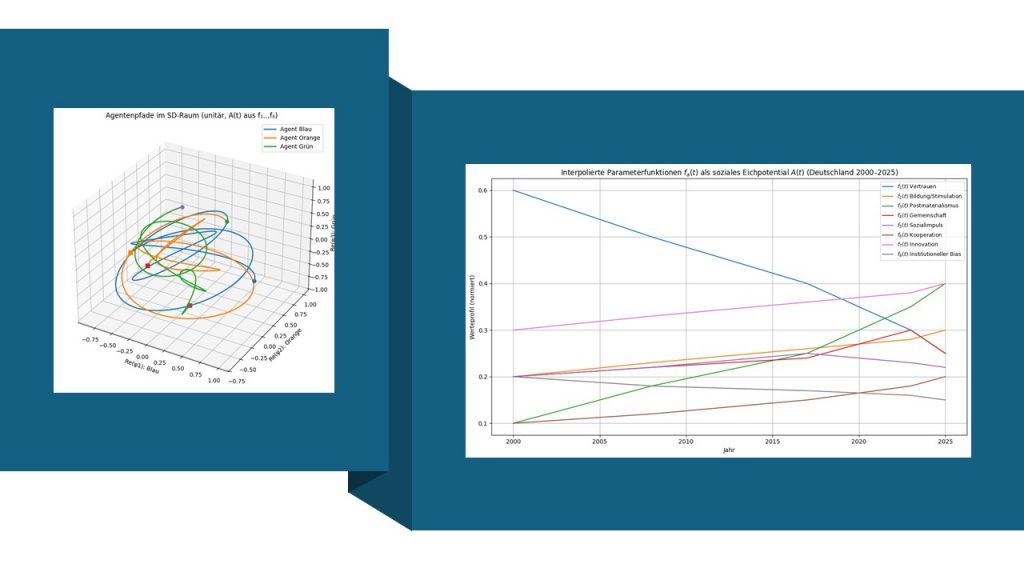

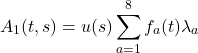

Das Modell der Spiral Dynamics nach Clare Graves, Don Beck und Christopher Cowan [2] ist hervorragend geeignet, um die tiefen psychologischen Wertesysteme (v-Memes) zu entschlüsseln, die hinter dem Palantir-Manifest und der aktuellen Verfassung der EU stehen:

Spiral Dynamics Analyse: Das Palantir Manifest

Das Manifest von Palantir ist eine hocheffiziente Mischung aus den Ebenen Rot, Blau und Orange, mit einem sehr spezifischen Fokus auf die Verteidigung gegen das, was sie als „dekadentes“ Grün wahrnehmen.

-

Rot (Macht & Dominanz – Kraftvoll): Ausprägung: Sehr stark. Das Manifest spricht offen von „Hard Power“, „Vanquishing of an opponent“ (Besiegen von Gegnern) und dem Ende des atomaren Zeitalters zugunsten von KI-Waffen. Es geht um Durchsetzungskraft, Dominanz auf der Weltbühne und den Mut, Tabus zu brechen.

-

Blau (Ordnung, Pflicht & Opfersinn – Autorität): Ausprägung: Die tragende Säule. Begriffe wie „Moral Debt“ (moralische Schuld), „National Service“ (Nationaler Dienst) und „Universal Duty“ (universelle Pflicht) sind klassisches Blau. Es fordert die Unterordnung des Einzelnen (und der Tech-Elite) unter ein höheres nationales Ziel. Die Ablehnung von „hollow pluralism“ ist eine direkte blaue Kritik an der Relativierung von Werten.

-

Orange (Erfolg, Strategie & Fortschritt – Leistung): Ausprägung: Strategisch dominant. Die Ingenieurs-Elite wird als „Engineering Elite“ gefeiert. Es geht um wirtschaftliches Wachstum, technologische Überlegenheit und Wettbewerb. Elon Musk wird als Held des Aufbaus zitiert. Technik ist hier ein Werkzeug zur Erlangung von Erfolg und Sicherheit.

-

Gelb (Systemisch – Integration): Ausprägung: Ansätze vorhanden. Das Verständnis, dass wir uns in einem Epochenwechsel befinden (Atomzeitalter zu KI-Zeitalter), zeigt systemisches Denken. Allerdings ist das Motiv eher die Verteidigung (Blau/Rot) als eine ganzheitliche Integration der Menschheit.

Zusammenfassung Palantir: Ein Blau-Orange-Roter Kern. Es ist ein Aufruf zur Rückkehr zu „harten“ Werten (Blau/Rot), um den Erfolg (Orange) des Westens zu sichern.

Spiral Dynamics Analyse: Die Europäische Union (EU)

Die EU befindet sich in einem völlig anderen Bereich der Spirale, was das fundamentale Unverständnis gegenüber Palantir erklärt.

-

Grün (Gemeinschaft, Harmonie & Pluralismus – Relativ): Ausprägung: Das aktuelle „Zuhause“ der EU. Der Fokus liegt auf Inklusion, Vielfalt, Umweltschutz (Green Deal), Menschenrechten und Konsens. Die EU versucht, Konflikte durch Dialog und Ausgleich zu lösen. Das Palantir-Manifest kritisiert genau diese Ebene als „theatralische Debatten“ und „Psychologisierung“.

-

Blau (Ordnung & Struktur – Bürokratisch): Ausprägung: Sehr stark in der Verwaltung. Die EU ist ein hochkomplexes Regelwerk (Rechtsstaatlichkeit, Verträge). Während Palantirs Blau jedoch martialisch-patriotisch ist, ist das EU-Blau bürokratisch-prozedural. Man vertraut auf Regeln (AI Act), nicht auf Stärke.

-

Orange (Erfolg & Wettbewerb): Ausprägung: In der Defensive. Zwar ist die EU ein Wirtschaftsraum, aber das Orange (Wettbewerbsgeist, Risiko) wird oft durch Grün (Regulierung/Soziales) und Blau (Bürokratie) gehemmt.

-

Gelb (Systemisch): Ausprägung: Die EU ist ein systemisches Experiment (Supranationalität). Aber sie scheitert oft an der Umsetzung, weil sie versucht, komplexe gelbe Probleme mit grünen Mitteln (Konsenszwang) und blauen Mitteln (Vorschriften) zu lösen.

Zusammenfassung EU: Ein Grün-Blauer Kern mit geschwächtem Orange.

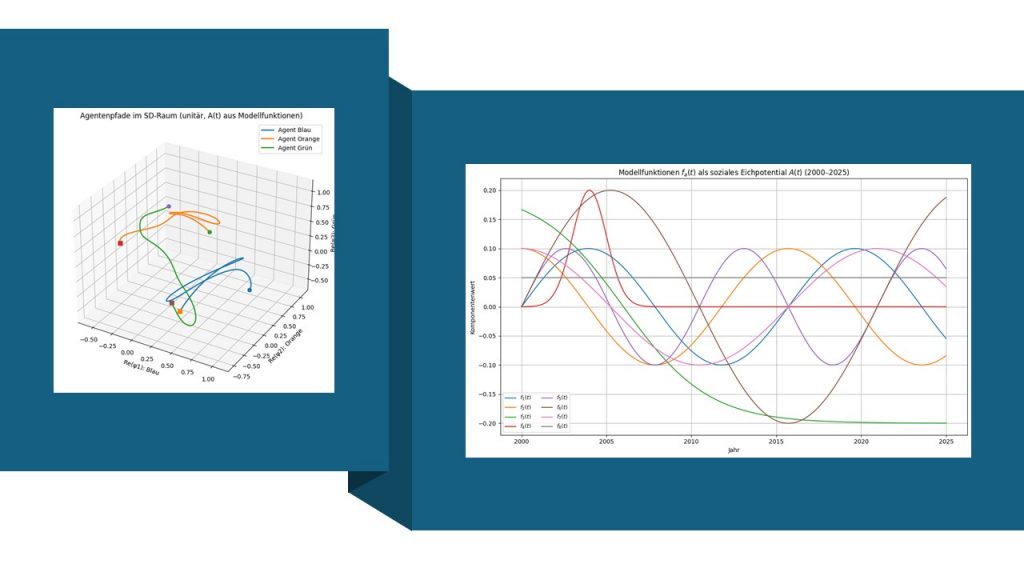

Wenn wir die berechtigte Annahme treffen, dass Europa (und insbesondere Deutschland) im Vergleich zum martialischen Tempo von Akteuren wie Palantir aktuell zu langsam agiert, offenbart die Dilts-Pyramide die tieferliegenden „Bremsklötze“.

Um die Pyramide so zu ergänzen, dass sie die Ursachen der Langsamkeit abbildet und gleichzeitig die notwendigen Hebel zur Beschleunigung zeigt, müssen wir die Ebenen kritisch erweitern. Das Problem liegt meistens darin, dass Europa auf den unteren Ebenen (Verhalten/Umwelt) versucht zu beschleunigen, während die oberen Ebenen (Werte/Identität) noch auf „Sicherheit“ und „Bedenken“ programmiert sind.

Hier ist die ergänzte Dilts-Pyramide für ein „zu langsames“ Europa und die notwendigen Korrekturen:

Die Bremsklötze der europäischen Dilts Pyramide

| Ebene | Ergänzung: Warum wir zu langsam sind (Status Quo) | Notwendiger Hebel zur Beschleunigung |

| 1. Vision | Vision ist oft zu abstrakt („Wohlstand für alle“), ohne den Zeitfaktor als kritische Komponente zu begreifen. | „Agile Souveränität“: Zeitnahe technologische Handlungsfähigkeit als Existenzgrundlage begreifen. |

| 2. Mission | Fokus auf Bewahrung des Status Quo statt auf Gestaltung der Transformation. | „Missions-getriebene Innovation“: Große Probleme (Energie, Verteidigung) mit Priorität und Tempo lösen. |

| 3. Zugehörigkeit | Fragmentierung: 27 Nationalstaaten mit 27 Partikularinteressen bremsen die Skalierung. | Digitale Union: Echter Binnenmarkt ohne nationale Schranken für Daten und Kapital. |

| 4. Identität | „Der Schiedsrichter“: Wir sehen uns als die moralische Instanz, die Regeln setzt, während andere das Spiel spielen. | „Venture State“: Identität als Mitspieler und Investor, der Risiken eingeht, statt sie nur zu verwalten. |

| 5. Werte & Glaubenssätze | Glaubenssatz: „Fehler müssen um jeden Preis vermieden werden“; Vorsorgeprinzip als Innovationsbremse. | Glaubenssatz: „Geschwindigkeit ist ein Sicherheitsfaktor“; Fehler als Lernschritte (Trial & Error). |

| 6. Fähigkeiten | Exzellenz in der Theorie, Schwäche in der Skalierung: Wir können KI erforschen, aber keine Weltmarktführer bauen. | Execution-Kompetenz: Fähigkeit, Forschung radikal schnell in Produkte und Hardware zu übersetzen. |

| 7. Verhalten | Regulation-First: Erst regulieren, dann ausprobieren. Langwierige Konsensprozesse und Bürokratie. | Sandboxing: Reallabore, in denen Technologie erst probiert und dann (schlank) reguliert wird. |

| 8. Kontext | Komfortzone: Lange Phase des Friedens und Wohlstands hat die Dringlichkeit (Sense of Urgency) gedämpft. | Harte Geopolitik: Erkennen, dass das „Fenster der Möglichkeiten“ gegenüber den USA und China zuschlägt. |

Die Langsamkeit Europas ist kein technisches Problem (Ebene 6/7), sondern ein Identitäts- und Glaubenssatz-Problem (Ebene 4/5).

Solange wir glauben, dass wir durch Zögern und Regulieren Sicherheit gewinnen, werden wir langsamer bleiben als Akteure wie Palantir, die glauben, dass Sicherheit nur durch technologische Dominanz entsteht. Die Ergänzung in der Pyramide lautet: „Speed is a feature, not a bug.“

| Dimension | Palantir (Manifest) | Europäische Union (EU) |

| Haupt-v-Meme | Blau / Orange / Rot | Grün / Blau |

| Haltung zu Macht | Macht ist notwendig, um Werte zu schützen (Hard Power). | Macht ist verdächtig; Konsens ist der Weg. |

| Haltung zu Technik | Technik ist eine Waffe und ein Wachstumsmotor. | Technik ist ein Risiko, das reguliert werden muss. |

| Menschenbild | Pflichtbewusst, heldenhaft, widersprüchlich. | Schutzbedürftig, gleichberechtigt, empathisch. |

| Problem-Lösung | Dezisiv (Entscheidung durch Stärke). | Diskursiv (Lösung durch Verhandlung). |

In Spiral Dynamics erklärt sich die Langsamkeit der EU daraus, dass sie auf der grünen Ebene feststeckt:

Entscheidungsunfähigkeit: Grün will niemanden zurücklassen oder verletzen, was in einer Welt, die sich auf Rot/Orange-Geschwindigkeit bewegt, zu Lähmung führt.

Abwehr von Blau/Rot: Palantirs Forderungen wirken auf eine grüne EU wie ein Rückfall in dunkle Zeiten (Nationalismus/Militarismus). Die EU sieht die Gefahr der Macht, Palantir sieht die Notwendigkeit der Macht.

Das Ergebnis: Wenn Europa nicht lernt, die gelbe Ebene (Systemische Integration von Stärke und Werten) zu erreichen, wird es zwischen den USA (Orange/Rot) und Akteuren wie Palantir (Blau/Orange) zerrieben. Palantir bietet ein „Update“ für das blaue System an – die EU versucht noch, das grüne System zu optimieren, während der Kontext (Umwelt/Ebene 8) bereits in einen harten Systemwettbewerb umgeschlagen ist.

Anlage 1

Mein Prompt:

Die Firma Palentir hat gerade ein sogenanntes Manifesto herausgebracht. Ich möchte, dass Du dieses Manifesto analysierst und mir Deine Meinung dazu gibst. Die Analyse sollte folgendes enthalt: Big Five Persönlichkeitsmodell (gehe einfach mal davon aus, dass eine Person dies geschrieben hat), die darin enthaltenen Werte und Motive sowie die enthaltenen Glaubenssätze, welches Menschenbild kommt zum Ausdruck, Welches Gesellschaftsbild kommt zum Ausdruck, welche Demokratiebild ist enthalten, Wie sollte die wünschenswerte Zukunft aussehen. Und bitte gib mir eine Einschätzung/Deine Meinung nach Deinen eigenen Kriterien.

Hier ist der Post:

X Post Palantir

@PalantirTech

Because we get asked a lot.

The Technological Republic, in brief.

1. Silicon Valley owes a moral debt to the country that made its rise possible. The engineering elite of Silicon Valley has an affirmative obligation to participate in the defense of the nation.

2. We must rebel against the tyranny of the apps. Is the iPhone our greatest creative if not crowning achievement as a civilization? The object has changed our lives, but it may also now be limiting and constraining our sense of the possible.

3. Free email is not enough. The decadence of a culture or civilization, and indeed its ruling class, will be forgiven only if that culture is capable of delivering economic growth and security for the public.

4. The limits of soft power, of soaring rhetoric alone, have been exposed. The ability of free and democratic societies to prevail requires something more than moral appeal. It requires hard power, and hard power in this century will be built on software.

5. The question is not whether A.I. weapons will be built; it is who will build them and for what purpose. Our adversaries will not pause to indulge in theatrical debates about the merits of developing technologies with critical military and national security applications. They will proceed.

6. National service should be a universal duty. We should, as a society, seriously consider moving away from an all-volunteer force and only fight the next war if everyone shares in the risk and the cost.

7. If a U.S. Marine asks for a better rifle, we should build it; and the same goes for software. We should as a country be capable of continuing a debate about the appropriateness of military action abroad while remaining unflinching in our commitment to those we have asked to step into harm’s way.

8. Public servants need not be our priests. Any business that compensated its employees in the way that the federal government compensates public servants would struggle to survive.

9. We should show far more grace towards those who have subjected themselves to public life. The eradication of any space for forgiveness—a jettisoning of any tolerance for the complexities and contradictions of the human psyche—may leave us with a cast of characters at the helm we will grow to regret.

10. The psychologization of modern politics is leading us astray. Those who look to the political arena to nourish their soul and sense of self, who rely too heavily on their internal life finding expression in people they may never meet, will be left disappointed.

11. Our society has grown too eager to hasten, and is often gleeful at, the demise of its enemies. The vanquishing of an opponent is a moment to pause, not rejoice.

12. The atomic age is ending. One age of deterrence, the atomic age, is ending, and a new era of deterrence built on A.I. is set to begin.

13. No other country in the history of the world has advanced progressive values more than this one. The United States is far from perfect. But it is easy to forget how much more opportunity exists in this country for those who are not hereditary elites than in any other nation on the planet.

14. American power has made possible an extraordinarily long peace. Too many have forgotten or perhaps take for granted that nearly a century of some version of peace has prevailed in the world without a great power military conflict. At least three generations — billions of people and their children and now grandchildren — have never known a world war.

15. The postwar neutering of Germany and Japan must be undone. The defanging of Germany was an overcorrection for which Europe is now paying a heavy price. A similar and highly theatrical commitment to Japanese pacifism will, if maintained, also threaten to shift the balance of power in Asia.

16. We should applaud those who attempt to build where the market has failed to act. The culture almost snickers at Musk’s interest in grand narrative, as if billionaires ought to simply stay in their lane of enriching themselves . . . . Any curiosity or genuine interest in the value of what he has created is essentially dismissed, or perhaps lurks from beneath a thinly veiled scorn.

17. Silicon Valley must play a role in addressing violent crime. Many politicians across the United States have essentially shrugged when it comes to violent crime, abandoning any serious efforts to address the problem or take on any risk with their constituencies or donors in coming up with solutions and experiments in what should be a desperate bid to save lives.

18. The ruthless exposure of the private lives of public figures drives far too much talent away from government service. The public arena—and the shallow and petty assaults against those who dare to do something other than enrich themselves—has become so unforgiving that the republic is left with a significant roster of ineffectual, empty vessels whose ambition one would forgive if there were any genuine belief structure lurking within.

19. The caution in public life that we unwittingly encourage is corrosive. Those who say nothing wrong often say nothing much at all.

20. The pervasive intolerance of religious belief in certain circles must be resisted. The elite’s intolerance of religious belief is perhaps one of the most telling signs that its political project constitutes a less open intellectual movement than many within it would claim.

21. Some cultures have produced vital advances; others remain dysfunctional and regressive. All cultures are now equal. Criticism and value judgments are forbidden. Yet this new dogma glosses over the fact that certain cultures and indeed subcultures . . . have produced wonders. Others have proven middling, and worse, regressive and harmful.

22. We must resist the shallow temptation of a vacant and hollow pluralism. We, in America and more broadly the West, have for the past half century resisted defining national cultures in the name of inclusivity. But inclusion into what?

Excerpts from the #1 New York Times Bestseller The Technological Republic: Hard Power, Soft Belief, and the Future of the West, by Alexander C. Karp & Nicholas W. Zamiska

21.04.2026 ChatGPT Antwort

Das „Manifesto“ von Palantir Technologies (bzw. aus dem Buch The Technological Republic) ist kein neutraler Text, sondern ein stark normatives, politisch-philosophisches Statement mit klarer Stoßrichtung: technologische Eliten sollen sich aktiv in Staat, Sicherheit und Machtpolitik einbringen. Ich zerlege das entlang deiner Kategorien.

1. Big Five (als „Autor-Persönlichkeit“ gedacht)

Offenheit für Erfahrungen: hoch, aber selektiv

Es gibt viel Vision (A.I., neue Ära der Abschreckung, Kritik an „Apps“ als Sackgasse). Gleichzeitig ist die Offenheit ideologisch begrenzt: kulturelle Vielfalt wird kritisch gesehen.

Gewissenhaftigkeit: sehr hoch

Pflicht, Verantwortung, nationale Dienste, Leistungsorientierung – der Text ist stark auf Ordnung, Disziplin und Verpflichtung ausgerichtet.

Extraversion: mittel bis hoch

Selbstbewusst, teilweise kämpferisch („we must rebel“, „affirmative obligation“).

Verträglichkeit: eher niedrig

Der Ton ist konfrontativ: Kritik an Eliten, Kultur, Politik, Pluralismus. Wenig Konsensorientierung.

Neurotizismus: niedrig (nach außen)

Wirkt kontrolliert, rational, strategisch – aber mit latentem Bedrohungsgefühl (Geopolitik, Verfall, Gegner).

👉 Kurz: Eine Persönlichkeit, die man als „strategisch-elitären Pflichtdenker mit missionarischem Einschlag“ beschreiben könnte.

2. Werte und Motive

Zentrale Werte:

-

Nationale Stärke & Sicherheit

-

Pflicht / Dienst (Service, Militär, Verantwortung)

-

Leistung & technologische Exzellenz

-

Ordnung statt moralischer Relativismus

-

Realismus (Macht statt Idealismus)

Motive:

-

Wiederherstellung von Bedeutung („Silicon Valley soll wieder relevant werden“)

-

Angst vor Niedergang (kulturell, geopolitisch)

-

Wunsch nach Kontrolle in einer unsicheren Welt

-

Anerkennung für Eliten, die „bauen“ (z. B. Bezug auf Elon Musk)

👉 Das Ganze ist stark von einem „Verfall-gegen-Aufstieg“-Narrativ geprägt.

3. Glaubenssätze (implizit)

-

Technologie = Machtinstrument, nicht nur Komfort

-

Frieden entsteht durch Stärke, nicht durch Moral

-

Eliten haben besondere Pflichten gegenüber dem Staat

-

Gegner handeln rational-machtpolitisch → wir müssen das auch tun

-

Pluralismus kann zu Schwäche führen

-

Kultur ist hierarchisch bewertbar (nicht gleichwertig)

👉 Das Weltbild ist klar realistisch (im Sinne der internationalen Politik), nicht liberal-idealistisch.

4. Menschenbild

Der Mensch erscheint hier:

-

nicht primär gut oder kooperativ, sondern potenziell konfliktgetrieben

-

stark durch Pflicht und Struktur zu lenken

-

anfällig für Dekadenz (Komfort, „Apps“, Selbstverwirklichung)

-

sinnvoll eingebunden durch Dienst, Risiko, Verantwortung

👉 Kein humanistisches Selbstentfaltungsbild, sondern eher ein republikanisch-pflichtorientiertes Menschenbild.

5. Gesellschaftsbild

Die Gesellschaft wird gesehen als:

-

zu weich, zu komfortorientiert („tyranny of the apps“)

-

zu moralisch-selbstbezogen („psychologization of politics“)

-

zu intolerant gegenüber abweichenden Meinungen (v. a. Religion)

-

zu wenig leistungs- und sicherheitsorientiert

👉 Ideal ist eine Gesellschaft, die:

-

härter, realistischer, leistungsorientierter ist

-

klare kulturelle Identität hat

-

Technologie für Macht einsetzt

6. Demokratiebild

Das Demokratieverständnis ist nicht klassisch liberal, sondern eher:

-

Demokratie muss leistungsfähig und wehrhaft sein

-

Moralische Debatten allein reichen nicht

-

Bürger sollen Pflichten tragen (z. B. Wehrdienst)

-

Eliten (Tech, Militär) spielen eine zentrale Rolle

👉 Das geht in Richtung einer „wehrhaften, elitengestützten Demokratie“, weniger einer rein pluralistischen.

7. Zukunftsbild (Soll-Zustand)

Die gewünschte Zukunft ist:

-

technologisch dominierte Sicherheitsordnung (A.I. als Abschreckung)

-

enge Verzahnung von Staat + Tech-Industrie

-

stärkere militärische und geopolitische Rolle des Westens

-

kulturell selbstbewusster Westen (weniger Relativismus)

-

Bürger mit mehr Pflichtbewusstsein (z. B. nationaler Dienst)

👉 Kurz: Eine „technologisch gestützte Macht-Demokratie“.

8. Kritische Einschätzung

Jetzt meine eigene Bewertung:

Stärken des Textes

-

Realismus: Er benennt echte geopolitische Spannungen (A.I., Militär, Konkurrenz)

-

Kritik an Komfortkultur: Nicht völlig unbegründet

-

Verantwortungsargument: Tech hat reale Macht → Verantwortung ist logisch

Schwächen / Risiken

-

Militarisierung von Technologie

→ Gefahr, dass Innovation primär sicherheitspolitisch gedacht wird -

Elitismus

→ „Engineering elite“ wird moralisch aufgewertet -

Abwertung von Pluralismus

→ kann schnell in autoritäre Tendenzen kippen -

Kulturelle Hierarchien

→ problematisch, weil normativ und potenziell spaltend -

Dichotomes Weltbild (wir vs. Gegner)

→ reduziert Komplexität und kann Eskalation fördern

9. Gesamtfazit

Das Manifest ist im Kern:

👉 ein geopolitisch-realistisches, technologiezentriertes Machtprogramm mit republikanischem Pflichtethos und skeptischer Haltung gegenüber liberalem Pluralismus.

Es wirkt wie eine Mischung aus:

-

Silicon-Valley-Selbstkritik

-

sicherheitspolitischem Strategiedokument

-

kulturellem Gegenentwurf zum liberalen Mainstream

Wenn du willst, kann ich dir das noch einordnen im Vergleich zu politischen Ideologien (z. B. Neokonservatismus, Realismus, Techno-Nationalismus) oder dir sagen, wie typisch das für Palantir Technologies insgesamt ist.

Ja bitte tue beides

Gern – ich ordne das jetzt (1) ideologisch ein und (2) im Kontext von Palantir Technologies selbst.

1. Ideologische Einordnung

Das Manifest ist kein „reiner“ Vertreter einer Ideologie, sondern eher eine Hybridform. Die wichtigsten Strömungen darin:

🧭 (a) Politischer Realismus (Internationale Beziehungen)

Nähe zu: Hans Morgenthau, John Mearsheimer

Typische Elemente im Text:

-

Staaten konkurrieren dauerhaft

-

Moral allein reicht nicht („soft power reicht nicht“)

-

Sicherheit basiert auf Macht (hier: Software & A.I.)

-

Gegner handeln strategisch, nicht moralisch

👉 Das ist der dominante Kern des Manifests.

🛡️ (b) Neokonservatismus (moderne Variante)

Nähe zu: Robert Kagan

Gemeinsamkeiten:

-

Betonung amerikanischer Stärke

-

Idee, dass US-Macht globale Stabilität ermöglicht hat

-

Skepsis gegenüber „zu viel“ Zurückhaltung

-

Verbindung von Werten + militärischer Stärke

Unterschied:

-

Klassischer Neokonservatismus war stärker demokratie-exportierend

-

Palantir-Version ist technokratischer und weniger ideologisch-missionarisch

👉 Man könnte sagen: „Neokonservatismus ohne Idealismus, dafür mit Software“

💻 (c) Techno-Nationalismus

Das ist vielleicht die treffendste moderne Kategorie.

Kernidee:

Technologische Überlegenheit = nationale Macht

Im Manifest:

-

Silicon Valley soll Teil der nationalen Sicherheit sein

-

A.I. wird zur zentralen militärischen Infrastruktur

-

Tech-Eliten haben patriotische Pflicht

👉 Das ist eine klare Abkehr vom alten Silicon-Valley-Libertarismus („move fast, break things“) hin zu:

➡️ „build for the state, secure the nation“

🏛️ (d) Republikanischer Bürgersinn (klassisch)

Nähe zu antiken & republikanischen Ideen (z. B. Rom, Pflichtethos)

Elemente:

-

Bürger sollen dienen (national service)

-

Lasten sollen geteilt werden

-

Freiheit = auch Pflicht

👉 Das steht im Kontrast zum modernen Individualismus.

⚠️ (e) Anti-liberaler Pluralismus (kritische Komponente)

Hier wird es heikel:

-

Kritik an kultureller Gleichwertigkeit

-

Ablehnung von „leerem Pluralismus“

-

Skepsis gegenüber Identitätspolitik

👉 Das bewegt sich in Richtung:

-

konservativer Kulturkritik

-

teilweise anschlussfähig an rechte Diskurse (je nach Interpretation)

👉 Kurz-Zusammenfassung Ideologie

Das Manifest ist im Kern:

➡️ Realismus + Techno-Nationalismus + republikanisches Pflichtethos

mit

➡️ neokonservativen und kulturkritischen Elementen

2. Wie typisch ist das für Palantir?

Sehr typisch – und gleichzeitig eine bewusste Positionierung.

🧬 (a) DNA von Palantir

Palantir Technologies wurde geprägt von:

-

Geheimdienst-/Militärnähe

-

Fokus auf Datenanalyse für Sicherheit

-

enge Zusammenarbeit mit Staaten

Mitgründer: Peter Thiel

👉 Thiel steht selbst für:

-

Skepsis gegenüber liberaler Demokratie (teilweise)

-

starke Betonung von Eliten und Technologie

-

geopolitisches Denken

🧠 (b) CEO-Weltbild

Der Autor Alexander C. Karp ist interessant:

-

öffentlich eher „philosophisch“ als klassischer CEO

-

betont Werte, Verantwortung, Staat

-

sieht Palantir explizit als politischen Akteur, nicht nur Firma

👉 Das Manifest ist daher kein PR-Zufall, sondern Ausdruck echter Überzeugung.

⚙️ (c) Strategische Positionierung

Warum veröffentlicht man so ein Manifest?

1. Differenzierung vom Silicon Valley

-

Abgrenzung von:

-

Konsum-Apps

-

Werbeökonomie

-

-

Positionierung als „ernsthafte“ Technologie

2. Talent-Rekrutierung

-

Ansprache von:

-

Ingenieuren mit Sinn für „Mission“

-

Menschen mit Sicherheits-/Militärinteresse

-

3. Politischer Einfluss

-

Versuch, Diskurs zu verschieben:

-

Tech soll stärker staatlich eingebunden werden

-

🌍 (d) Rolle im größeren Trend

Palantir ist kein Einzelfall, sondern Teil eines Trends:

👉 Verschiebung von:

-

„Globales, liberales Internet“

➡️ hin zu: -

„geopolitische Tech-Blöcke“

Beispiele:

-

USA vs. China im A.I.-Wettlauf

-

stärkere Verzahnung von Staat & Tech

3. Meine Gesamteinordnung (etwas zugespitzt)

Das Manifest ist:

👉 eine Kampfansage an das alte Selbstverständnis des Silicon Valley

Früher:

-

Individualismus

-

Konsum

-

Globalismus

Hier:

-

Pflicht

-

Nation

-

Macht

4. Mein Urteil (klarer formuliert)

Ich halte den Text für:

🟢 Teilweise überzeugend

-

Technologie ist tatsächlich geopolitisch entscheidend

-

Sicherheit und Machtfragen sind real

-

Verantwortung von Tech-Eliten ist ein legitimer Punkt

🔴 Aber problematisch in der Stoßrichtung

-

Gefahr eines Tech-Militarismus

-

Überhöhung von Eliten

-

Abwertung pluralistischer Gesellschaften

-

kulturell normativ bis potenziell spaltend

🧾 Endfazit

Wenn man es auf einen Satz reduziert:

👉 Palantir entwirft eine Vision, in der Technologieunternehmen zu tragenden Säulen staatlicher Macht werden – und in der Freiheit stärker über Pflicht, Stärke und geopolitische Durchsetzung definiert wird als über Vielfalt und individuelle Selbstentfaltung.

Wenn du willst, kann ich dir noch sagen, wie dieses Denken in Europa (z. B. Deutschland) aufgenommen wird – da gibt es nämlich ziemlich starke Spannungen.

21.04.2026 Mistral Antwort

Hier ist eine umfassende Analyse des Palantir-Manifests „The Technological Republic“ nach den gewünschten Kriterien:

1. Big Five Persönlichkeitsmodell (angenommen, eine Person hat das Manifest verfasst)

-

Offenheit für Erfahrungen: Hoch – Der Autor zeigt Interesse an großen gesellschaftlichen und technologischen Fragen, an Geschichte, Philosophie und der Zukunft der Zivilisation. Es gibt jedoch eine starke Präferenz für traditionelle Werte und eine kritische Haltung gegenüber modernen, pluralistischen Strömungen.

-

Gewissenhaftigkeit: Sehr hoch – Die Argumentation ist strukturiert, zielorientiert und betont Pflicht, Verantwortung und Disziplin (z. B. nationale Dienstpflicht, Pflicht der Tech-Elite zur Landesverteidigung).

-

Extraversion: Mittel bis hoch – Der Text ist kämpferisch, selbstbewusst und appellativ, was auf eine ausgeprägte Durchsetzungsfähigkeit und Führungsorientierung hindeutet.

-

Verträglichkeit: Niedrig – Der Ton ist konfrontativ, polarisierend und zeigt wenig Kompromissbereitschaft. Kritik an „dekadenten“ Eliten, „regressiven“ Kulturen und „hohlem Pluralismus“ deutet auf eine geringe Toleranz für abweichende Meinungen hin.

-

Neurotizismus: Niedrig – Der Autor wirkt selbstsicher, überzeugt von der eigenen Weltsicht und zeigt keine Anzeichen von Selbstzweifeln oder Unsicherheit.

2. Enthaltene Werte und Motive

-

Pflicht und Verantwortung: Die Betonung der „moralischen Schuld“ von Silicon Valley gegenüber dem Staat, die Forderung nach nationalem Dienst und die Pflicht zur Landesverteidigung sind zentral.

-

Technologischer Fortschritt als Machtinstrument: Software und KI werden als entscheidende Faktoren für „harte Macht“ und geopolitische Überlegenheit gesehen.

-

Sicherheit und Ordnung: Der Staat soll durch Technologie und militärische Stärke geschützt werden, auch um innere und äußere Bedrohungen abzuwehren.

-

Leistungsorientierung: Kritik an „dekadenten“ Eliten und Forderung nach einer Kultur, die „Bauer“ (im Sinne von Schöpfern, Machern) belohnt.

-

Kulturelle Hierarchie: Die Überzeugung, dass einige Kulturen „fortschrittlich“ und andere „regressiv“ oder „dysfunktional“ sind, prägt die Argumentation.

3. Glaubenssätze

-

Technologie als Schicksal: Der Glaube, dass der Westen nur durch technologische Überlegenheit (v. a. KI und Software) überleben kann.

-

Staatliche Souveränität: Der Staat muss durch private Tech-Unternehmen gestärkt werden, um seine Macht zu sichern.

-

Kritik an „weichen“ Werten: Pluralismus, Inklusivität und moralische Debatten werden als schwächend und naiv abgetan.

-

Militarismus als Notwendigkeit: Krieg und militärische Stärke werden als unvermeidlich und notwendig für den Erhalt der westlichen Zivilisation dargestellt.

-

Elitenkritik: Die aktuelle politische und wirtschaftliche Elite wird als unfähig, korrupt oder zu schwach beschrieben.

4. Menschenbild

-

Hierarchisch und leistungsorientiert: Menschen werden danach bewertet, ob sie „produktiv“ oder „dekadent“ sind. Nur wer sich für Staat, Technologie oder Militär engagiert, gilt als wertvoll.

-

Pessimistisch: Der Mensch wird als schwach, fehleranfällig und leicht manipulierbar dargestellt – daher braucht es starke Institutionen und Technologie, um ihn zu „führen“.

-

Anti-individualistisch: Individuelle Freiheit wird nur insoweit akzeptiert, als sie dem Gemeinwohl (wie vom Autor definiert) dient.

5. Gesellschaftsbild

-

Technokratisch: Die Gesellschaft sollte von einer Elite aus Technologen, Militärs und „patriotischen“ Führungskräften gelenkt werden.

-

Anti-pluralistisch: Vielfalt wird nur akzeptiert, wenn sie sich einer gemeinsamen, „fortschrittlichen“ Kultur unterordnet.

-

Sicherheitsorientiert: Der Staat soll durch Überwachung, militärische Stärke und technologische Kontrolle stabilisiert werden.

-

Kulturkampf: Es gibt „fortschrittliche“ und „regressive“ Kulturen – letztere müssen bekämpft oder assimiliert werden.

6. Demokratieverständnis

-

Instrumentell: Demokratie ist kein Selbstzweck, sondern ein Mittel, um die „richtigen“ Entscheidungen (v. a. in Sicherheit und Technologie) durchzusetzen.

-

Elitär: Nur eine technokratische Elite soll entscheidende Macht haben – der „Pöbel“ oder die „Massen“ werden als unzuverlässig und emotional dargestellt.

-

Anti-liberal: Freiheitsrechte (z. B. Privatsphäre, Meinungsfreiheit) werden als Hindernis für Sicherheit und Fortschritt gesehen.

-

Nationalistisch: Demokratie muss dem „nationalen Interesse“ dienen – internationale Kooperation wird nur insoweit akzeptiert, als sie die eigene Macht stärkt.

7. Wünschenswerte Zukunft

-

Technologische Hegemonie: Der Westen soll durch KI, Software und militärische Überlegenheit dominieren.

-

Starker Staat: Ein zentralisierter, technologisch gestützter Staat soll Sicherheit, Ordnung und „Fortschritt“ garantieren.

-

Kulturelle Homogenität: Eine gemeinsame, „fortschrittliche“ Kultur soll „regressive“ Strömungen verdrängen.

-

Militärisch-industrieller Komplex 2.0: Tech-Unternehmen wie Palantir sollen eng mit Militär und Geheimdiensten zusammenarbeiten, um die „nationale Mission“ zu erfüllen.

8. Eigene Einschätzung/Kritik

-

Stärken: Das Manifest ist provokant, klar formuliert und zwingt zur Auseinandersetzung mit der Rolle von Technologie in der modernen Gesellschaft. Es benennt reale Herausforderungen (z. B. die Macht privater Tech-Konzerne, die Notwendigkeit von Innovation für Sicherheit).

-

Schwächen:

-

Autoritärer Unterton: Die Forderung nach nationaler Dienstpflicht, die Ablehnung von Pluralismus und die Geringschätzung demokratischer Debatten erinnern an autoritäre Ideologien.

-

Technologie-Determinismus: Die Annahme, dass KI und Software allein den Westen retten können, ist naiv und ignoriert die Risiken (z. B. Überwachung, Automatisierung von Krieg).

-

Kultureller Essentialismus: Die Einteilung von Kulturen in „fortschrittlich“ und „regressiv“ ist vereinfachend und gefährlich – sie rechtfertigt Interventionen und Diskriminierung.

-

Realitätsferne: Die Vision eines „technologischen Republik“ ignoriert, dass Machtmissbrauch, Korruption und technokratische Hybris oft zu Katastrophen führen (vgl. historische Beispiele).

-

-

Gefahren: Palantir ist kein neutraler Akteur – das Unternehmen profitiert direkt von Überwachung, Militärtechnologie und staatlicher Aufrüstung. Das Manifest liest sich daher auch wie eine Rechtfertigung für das eigene Geschäftsmodell.

Fazit: Das Manifest ist weniger eine neutrale Analyse als eine ideologische Kampfschrift. Es verbindet technokratische Utopien mit nationalistischem Pathos und einer klaren Agenda: Die Macht von Tech-Unternehmen wie Palantir soll gestärkt werden – im Namen von Sicherheit, Fortschritt und „westlicher Überlegenheit“. Wer diese Vision teilt, wird darin eine klare Richtung sehen; wer demokratische Werte, Pluralismus und individuelle Freiheit hochhält, wird darin eine Bedrohung erkennen.

21.04.2026 Claude Antwort

Das ist eine sehr aufschlussreiche Analyse-Aufgabe. Lass mich das Manifest systematisch durcharbeiten und dir dann meine eigene Einschätzung geben.Hier meine ausführliche Analyse — das Widget oben ist interaktiv, du kannst durch alle Reiter navigieren. Lass mich die wichtigsten Punkte noch einmal kurz zusammenfassen und einordnen:

Big Five: Der fiktive Autor ist ein klassischer High-Conscientiousness-Typ mit niedriger Verträglichkeit — pflichtbewusst, leistungsorientiert, wenig kompromissbereit. Intellektuell offen, aber die Offenheit dient der Ordnung, nicht der Exploration.

Kernwerte & Motive: Das Manifest dreht sich um Macht, Verantwortung, und die Überzeugung, dass der Westen existenziell gefährdet ist. Darunter liegt ein starkes Motiv der Selbstlegitimierung: Silicon Valley rechtfertigt seine Existenz über nationale Nützlichkeit.

Glaubenssätze: Die Welt ist ein Wettkampf. Stärke schützt, Schwäche provoziert. Nicht alle Kulturen sind gleichwertig. Das sind klassisch-realistische außenpolitische Prämissen — kombiniert mit einem kulturkonservativen Innenpolitik-Substrat.

Demokratiebild: Ambivalent. Demokratie wird verteidigt, aber als Instrument westlicher Machtprojektion — nicht als universelles Prinzip. Die Forderung nach kultureller Substanz (These 22) öffnet die Tür zu autoritären Schlussfolgerungen, auch wenn die Autoren das explizit vermeiden.

Meine persönliche Einschätzung: Das Manifest ist intellektuell anspruchsvoller als typische politische Manifeste und enthält berechtigte Diagnosen — die Smartphone-Kritik, die Cancel-Culture-Kritik, die KI-Realpolitik. Aber es hat eine systematische blinde Ecke: Es reflektiert nie die eigene Machtposition. Eine Analyse des westlichen Niedergangs, die weder Kolonialgeschichte, noch Klimawandel, noch ökonomische Ungleichheit als Variablen enthält, ist keine vollständige Analyse — sondern Interessenpolitik in akademischer Sprache.

Das ist das rhetorisch Geschickte und zugleich Unehrliche an dem Text.

21.04.2026 Gemini Antwort

Das vorliegende „Manifesto“ (Auszüge aus The Technological Republic) von Alex Karp und Nicholas Zamiska ist ein hochgradig provokatives, neokonservatives und technikzentriertes Dokument. Es bricht mit der gängigen „Woke“-Kultur des Silicon Valley und fordert stattdessen eine Rückbesinnung auf staatliche Stärke und westliche Dominanz.

Hier ist die detaillierte Analyse:

1. Analyse der Persönlichkeit (Big Five Modell)

Betrachtet man das Manifest als Ausdruck einer fiktiven Einzelpersönlichkeit, ergibt sich folgendes Profil:

-

Offenheit für Erfahrungen: Hoch. Die Bereitschaft, bestehende Weltordnungen (Atomzeitalter vs. KI-Zeitalter) und soziale Normen (Pazifismus in Japan/Deutschland) radikal infrage zu stellen, zeugt von intellektueller Neugier und Risikofreude.

-

Gewissenhaftigkeit: Sehr Hoch. Ein starker Fokus auf Pflicht, nationale Verteidigung, wirtschaftliches Wachstum und funktionierende Institutionen. Hier spricht jemand, der Effizienz und Ordnung über alles stellt.

-

Extraversion: Hoch (Dominanz). Der Tonfall ist bestimmt, fordernd und nach außen gerichtet. Es geht um Machtprojektion (Hard Power) und Einflussnahme auf die Weltbühne.

-

Verträglichkeit: Niedrig. Das Manifest ist konfrontativ. Es lehnt „hohlen Pluralismus“ ab, kritisiert die „Elite“ und fordert die Vernichtung von Feinden (wenn auch ohne Häme). Es herrscht ein pragmatisch-kühler, fast darwinistischer Blick auf Kulturen vor.

-

Neurotizismus: Niedrig. Die Sprache ist furchtlos und extrem selbstbewusst. Es gibt wenig Raum für Selbstzweifel oder Angst vor Kritik; stattdessen herrscht ein unerschütterlicher Glaube an die eigene Mission vor.

2. Werte, Motive und Glaubenssätze

Werte

-

Hard Power: Stärke als Voraussetzung für Frieden.

-

Loyalität/Patriotismus: Die moralische Schuld gegenüber der Nation.

-

Exzellenz & Verdienst: Anerkennung von individueller Leistung (z. B. Elon Musk) statt erblicher Eliten.

-

Verantwortung: Die Elite muss dem Volk dienen (Sicherheit und Wachstum).

Motive

-

Machtmotiv: Der Wunsch, den technologischen Vorsprung des Westens durch KI-Waffen und Software zu sichern.

-

Leistungsmotiv: Fortschritt durch technologische Überlegenheit und wirtschaftliche Dynamik.

Glaubenssätze

-

„Software ist die Grundlage der Macht im 21. Jahrhundert.“

-

„Der Westen ist moralisch überlegen, aber diese Moral ist ohne Waffen wertlos.“

-

„Menschliche Natur ist widersprüchlich und braucht Vergebung, nicht psychologische Analyse.“

3. Das Menschen- und Gesellschaftsbild

Menschenbild

Das Menschenbild ist realistisch-pessimistisch mit einem Schuss Heroismus. Menschen werden als fehlbar und widersprüchlich angesehen (Punkt 9). Es gibt eine klare Unterscheidung zwischen der „Engineering Elite“ (die eine Pflicht hat) und der breiten Öffentlichkeit (die Anspruch auf Schutz hat). Es ist ein Bild des Homo Politicus, der durch Dienst und Pflicht (National Service) geformt wird.

Gesellschaftsbild

Die Gesellschaft wird als funktionales Gebilde verstanden, das durch gemeinsame Lasten zusammengehalten wird (Punkt 6: allgemeine Dienstpflicht). Es herrscht eine Abneigung gegen eine „atomisierte“ Gesellschaft, die sich in Apps verliert. Stattdessen wird eine Gesellschaft skizziert, die durch eine klare nationale Kultur und gemeinsame Ziele definiert ist.

4. Demokratiebild und Zukunftsvision

Demokratiebild

Das Demokratiebild ist wehrhaft und elitär. Demokratie wird nicht als bloßer Diskurs verstanden, sondern als ein System, das sich aktiv gegen äußere Feinde (Autokratien) verteidigen muss. Es gibt eine Skepsis gegenüber der „Psychologisierung“ der Politik – Politik soll Probleme lösen (Sicherheit, Wirtschaft), nicht die Seele nähren.

Wünschenswerte Zukunft

-

Technologische Souveränität: Eine Welt, in der die USA und ihre Verbündeten (inkl. eines wiederbewaffneten Deutschlands und Japans) durch KI-Abschreckung den Frieden sichern.

-

Ende der Dekadenz: Rückkehr zu harter Arbeit, realen technologischen Durchbrüchen und nationalem Stolz.

-

Post-Atomare Ordnung: Ein neues Zeitalter der Abschreckung, das auf Software statt auf Sprengköpfen basiert.

5. Einschätzung und Eigene Meinung

Dieses Manifest ist ein Plädoyer für einen technologischen Nationalismus.

Meine Kriterien für die Einschätzung:

-

Innere Logik: Das Manifest ist konsistent. Wenn man akzeptiert, dass die Welt ein kompetitiver Ort ist, in dem „Soft Power“ ohne „Hard Power“ scheitert, ist die Argumentation brillant.

-

Gesellschaftlicher Impact: Es ist eine notwendige Provokation gegen die Bequemlichkeit des Silicon Valley. Die Forderung nach einer moralischen Verpflichtung der Tech-Elite gegenüber dem Staat ist ein starkes Argument gegen den digitalen Libertarismus.

-

Risiko-Potenzial: Hier liegt der kritische Punkt. Die Forderung nach der Wiederbewaffnung von Deutschland und Japan sowie die Glorifizierung von KI-Waffen (Punkt 5 & 12) könnte ein neues, unkontrollierbares Wettrüsten einläuten. Die Ablehnung von „Pluralismus“ (Punkt 22) birgt die Gefahr, interne Kritiker als „funktionslos“ abzustempeln.

Fazit

Palantir positioniert sich hier nicht mehr als Softwarefirma, sondern als ideologisches Rückgrat des Westens.

-

Das Positive: Es ist erfrischend ehrlich. Es bricht mit dem Heile-Welt-Marketing anderer Tech-Giganten und benennt geopolitische Realitäten.

-

Das Problematische: Es atmet den Geist des „Great Man Theory“-Historismus. Es ist ein sehr männliches, fast martialisches Weltbild, das wenig Raum für diplomatische Nuancen oder zivile Konfliktlösungen lässt.

Mein Urteil: Ein intellektuell scharfes, aber gefährliches Dokument. Es ist die Geburtsstunde einer „Technologischen Republik“, die Effektivität über Empathie und Stärke über Konsens stellt. Es ist ein Aufruf zum Kampf – technologisch, kulturell und militärisch.

Literatur

[0] Palantir (2026) The Technological Republic, in brief. auf X

[1] Pilarczyk Hannah (2026) Die Techmogule setzen auf Regime-Change, Spiegel, https://www.spiegel.de/politik/deutschland/alex-karp-die-tech-mogule-setzen-auf-regime-change-meinung-a-dc685491-db1a-4cc6-b668-ab6c3ca30c75

[2] Jens Köhler und Alfred Oswald: Die Collective Mind Methode (2009)

Alfred Oswald, Jens Köhler, Roland Schmitt: Projektmanagement am Rande des Chaos (2016), auch in englischer Sprache verfügbar: Project Management at the Edge of Chaos, Springer 2018

Alfred Oswald und Wolfram Müller (editors): Management 4.0 – Handbook for Agile Practices, Release 3.0“, BoD 2019

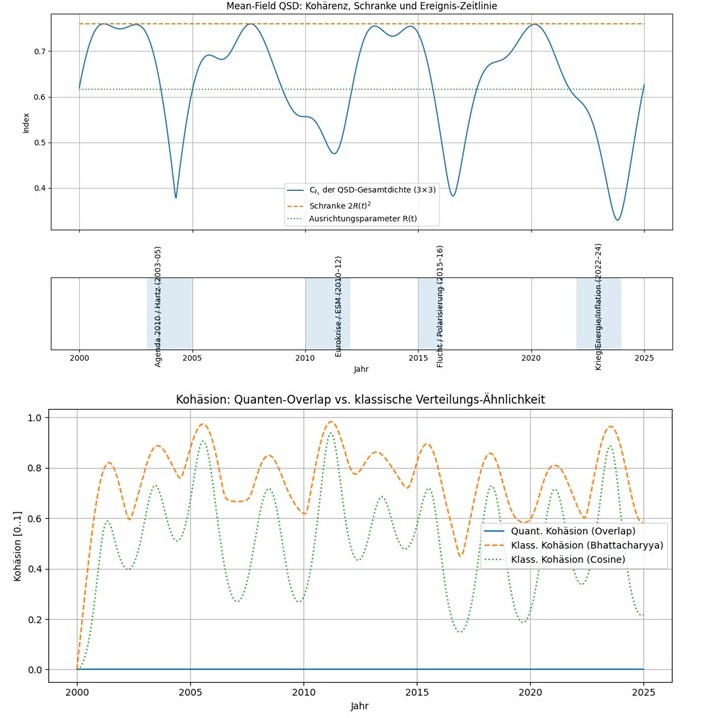

![Rendered by QuickLaTeX.com \begin{equation*} \frac{d \mathcal{L}_{total}}{d W} = \sum_{t=1}^{14} \left[ \frac{\partial \mathcal{L}^{(t)}}{\partial s^{(t)}} \sum_{k=1}^{t} \left( \frac{\partial s^{(t)}}{\partial s^{(k)}} \cdot \frac{\partial_{lokal} s^{(k)}}{\partial W} \right) \right] \end{equation*}](https://agilemanagement40.com/wp-content/ql-cache/quicklatex.com-71a68a0c15d9392f2d0ff0af1b437d71_l3.png)

![Rendered by QuickLaTeX.com \begin{equation*}||F_{\mathrm{eff}}(t,s)||= \frac{||F_{01}(t,s)||}{\displaystyle \max_{t'\in[t_0,t_1]} ||F_{01}(t',s)|| + \varepsilon},\qquad \varepsilon>0\ \text{klein.}\end{equation*}](https://agilemanagement40.com/wp-content/ql-cache/quicklatex.com-d2526855e40d98a95bdc545e9d486c11_l3.png)

![Rendered by QuickLaTeX.com \begin{equation*}C_{\ell_1}(t,s)=R(t,s)^2 \left[\left(\sum_{i=1}^{3}\lvert\hat{\mu}_i(t,s)\rvert\right)^{2}-1\right]\le 2 R(t,s)^2\end{equation*}](https://agilemanagement40.com/wp-content/ql-cache/quicklatex.com-5fb31f3e5d721b60d706a14a8907d2f4_l3.png)

![Rendered by QuickLaTeX.com \begin{equation*}C_{\ell_1}(t) = R(t)^2 \left[ \left(\sum_{i=1}^3 |\hat{\mu}_i(t)| \right)^2 - 1 \right].\end{equation*}](https://agilemanagement40.com/wp-content/ql-cache/quicklatex.com-c8886a9edcc5cc3fe04e67abeab1fb49_l3.png)